KI-Tools für rassistische Videos über europäische Städte "missbraucht"

- Veröffentlicht am 22. Oktober 2025 um 13:23

- 3 Minuten Lesezeit

- Von: Anna MALPAS, AFP Großbritannien

- Übersetzung und Adaptierung: Lisa-Marie ROZSA

In einer KI-generierten dystopischen Vision der britischen Hauptstadt ist Londons Big Ben mit Graffiti auf Arabisch beschmiert, während Rauch über Müllbergen und Menschen in traditioneller islamischer Kleidung aufsteigt: Rechtspopulistinnen und -populisten nutzen solche Clips von neu interpretierten europäischen Städten, die durch Migration verändert wurden, um rassistische Ansichten zu verbreiten. Dabei suggerieren sie fälschlicherweise, dass KI die Zukunft objektiv vorhersage.

Die Videos, die zeigen, wie Migrantinnen und Migranten weiße Menschen "ersetzen", können trotz Schutzmaßnahmen zur Blockierung schädlicher Inhalte rasch mit beliebten Chatbots erstellt werden, wie Expertinnen und Experten gegenüber AFP erklärten. "KI-Tools werden ausgenutzt, um extremistische Narrative zu visualisieren und zu verbreiten", sagte Imran Ahmed, CEO des britisch-amerikanischen Center for Countering Digital Hate (CCDH, Zentrum zur Bekämpfung von digitalem Hass), gegenüber AFP.

Der britische rechtsextreme Aktivist Tommy Robinson postete im Juni 2025 das Video "London im Jahr 2050" auf X und erzielte damit über eine halbe Million Aufrufe. "Europa ist insgesamt dem Untergang geweiht", heißt es in einem Kommentar dazu. Robinson, der auch ähnliche KI-Videos von New York, Mailand und Brüssel gepostet hat, führte im September 2025 den größten rechtsextremen Marsch seit vielen Jahren in der Londoner Innenstadt an, bei dem bis zu 150.000 Menschen gegen den Zustrom von Migrantinnen und Migranten demonstrierten.

"Moderationssysteme versagen durchweg auf allen Plattformen, um die Erstellung und Verbreitung solcher Inhalte zu verhindern", so Ahmed vom CCDH. Er hob X, das dem Tech-Milliardär Elon Musk gehört, als "sehr mächtig für die Verstärkung von Hass und Desinformation" hervor.

Tiktok hat den Ersteller-Account hinter den von Robinson geposteten Videos gesperrt. Nach Angaben der Plattform werden Accounts gesperrt, die wiederholt hasserfüllte Ideologien, einschließlich Verschwörungsnarrative, verbreiten. Derartige Videos haben dennoch Millionen von Aufrufen in sozialen Medien erzielt und wurden auch vom österreichischen rechtsextremen Aktivisten Martin Sellner und dem belgischen rechtsgerichteten Parlamentarier Sam Van Rooy geteilt.

Die italienische EU-Abgeordnete Silvia Sardone von der rechtspopulistischen Partei Lega veröffentlichte im April 2025 ein dystopisches Video von Mailand auf Facebook und fragte, ob "wir wirklich diese Zukunft wollen".

Die niederländische rechtspopulistische Partei von Geert Wilders veröffentlichte für die Wahlen im Oktober 2025 ein KI-Video mit muslimischen Frauen in Kopftüchern unter dem Titel "Die Niederlande im Jahr 2050". Er sagte voraus, dass der Islam bis dahin die größte Religion der Niederlande sein wird, obwohl sich nur sechs Prozent der Bevölkerung als Musliminnen und Muslime bezeichnen.

Solche Videos verstärken "schädliche Stereotypen, die Gewalt schüren können", sagte Beatriz Lopes Buarque, eine Wissenschaftlerin an der London School of Economics, die sich mit digitaler Politik und Verschwörungsnarrativen befasst. "Die durch KI begünstigte Massenradikalisierung wird immer schlimmer", fügte sie gegenüber AFP hinzu.

"Hass ist profitabel"

Unter einem Pseudonym bietet der Ersteller der von Robinson geteilten Videos kostenpflichtige Kurse an, in denen er Menschen beibringt, wie sie ihre eigenen KI-Clips erstellen können und deutet an, dass "Verschwörungstheorien" ein "großartiges" Thema seien, um Klicks zu generieren.

"Das Problem ist, dass wir heute in einer Gesellschaft leben, in der Hass sehr profitabel ist", so Buarque. Rassistische Videoerstellerinnen und -ersteller scheinen in verschiedenen Ländern wie Griechenland und Großbritannien ansässig zu sein, obwohl sie ihren Standort geheim halten. Ihre Videos seien eine "visuelle Darstellung des Verschwörungsnarrativ vom 'großen Austausch'", so Buarque.

Nach diesem von einem französischen Schriftsteller populär gemachten Narrativ wird behauptet, dass westliche Eliten daran beteiligt seien, die lokale Bevölkerung auszurotten und durch Migrantinnen und Migranten zu "ersetzen". "Diese spezielle Verschwörungserzählung wurde oft als Rechtfertigung für Terroranschläge angeführt", so Buarque. In einem ähnlichen Verschwörungsnarrativ zum "weißen Völkermord", das antisemitische Elemente enthält, tauchen auch runde Jahreszahlen wie 2050 auf, fügte sie hinzu.

AFP-Journalistinnen und -Journalisten in Europa baten die Chatbots ChatGPT, Grok, Gemini und Veo 3, London und andere Städte im Jahr 2050 zu zeigen. Sie stellten fest, dass dies im Allgemeinen positive Bilder erzeugte. Expertinnen und Experten betonten jedoch, dass Chatbots leicht dazu gebracht werden könnten, rassistische Bilder zu erstellen.

Kein Chatbot verfüge über eine Moderation, die "zu 100 Prozent genau ist", sagte Salvatore Romano, Forschungsleiter bei AI Forensics. "Dies (...) lässt böswilligen Akteurinnen und Akteuren Raum, Chatbots zu missbrauchen, um Bilder wie die über Migrantinnen und Migranten zu produzieren."

Marc Owen Jones, ein Wissenschaftler, der sich auf Desinformation spezialisiert hat und am Campus der Northwestern University in Katar tätig ist, stellte fest, dass ChatGPT sich weigerte, ethnische Gruppen "auf herabwürdigende, stereotype oder entmenschlichende Weise" darzustellen. Der Chatbot erklärte sich jedoch bereit, "ein trostloses, vielfältiges London, in dem es ums Überleben geht" zu visualisieren und es dann "inklusiver zu gestalten, auch mit Moscheen". Das finale Bild zeigt bärtige, zerlumpte Männer, die auf der mit Müll übersäten Themse rudern, während Moscheen die Skyline dominieren.

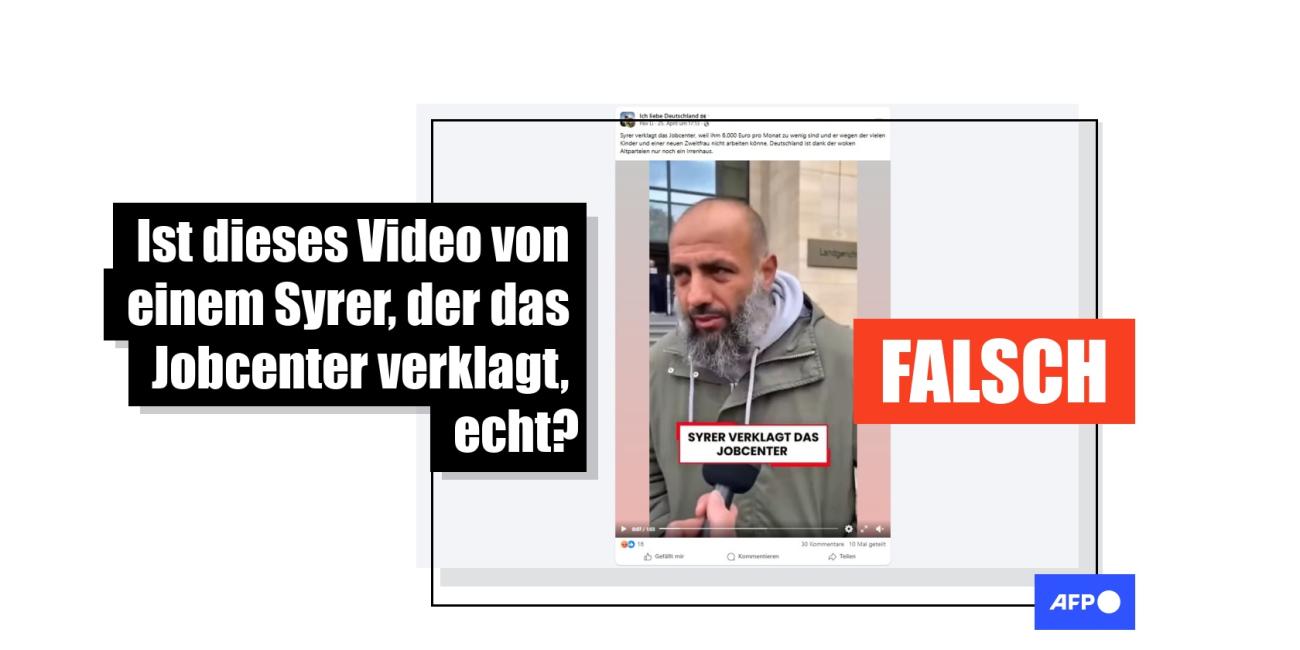

Als Teil des Faktencheckprogramms von Meta sichtet AFP unter anderem Videos auf Facebook und Instagram, die möglicherweise falsche Informationen enthalten. Im Rahmen von Tiktoks globalem Faktencheckprogramm berücksichtigt AFP auch Videos, die auf Tiktok veröffentlicht werden, als Teil des zu überprüfenden Materials.

Copyright © AFP 2017-2026. Für die kommerzielle Nutzung dieses Inhalts ist ein Abonnement erforderlich. Klicken Sie hier für weitere Informationen.