KI-generiert: Video von angeblichen Angriffen auf Tel Aviv ist unecht

- Veröffentlicht am 6. März 2026 um 17:48

- Aktualisiert am 12. März 2026 um 18:51

- 5 Minuten Lesezeit

- Von: Pierre MOUTOT, AFP Frankreich

- Übersetzung und Adaptierung: AFP Deutschland

Seit den Luftangriffen der USA und Israels auf den Iran am 28. Februar 2026 reagieren die iranischen Revolutionsgarden mit Gegenangriffen auf Israel und US-Stützpunkte sowie -Einrichtungen in mehreren Golfstaaten. Vor diesem Hintergrund wurde ein Video, das angeblich Raketenangriffe auf die israelische Stadt Tel Aviv zeigen soll, millionenfach online angesehen. Der Clip wurde jedoch höchstwahrscheinlich mithilfe Künstlicher Intelligenz erstellt. Es gibt keine Hinweise darauf, dass das abgebildete Ereignis tatsächlich stattgefunden hat.

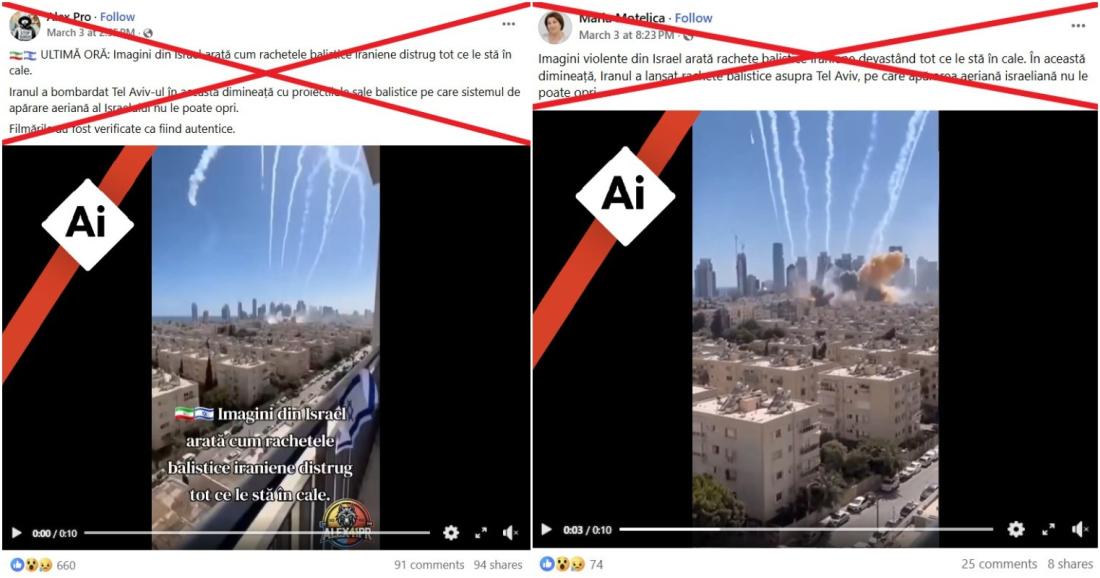

"Einblicke, wie ihr sie im ÖRR oder den MSM nicht bekommen werdet! ... Das Video zeigt mit großer Wahrscheinlichkeit die Bombardierungen des #Iran auf #Tel Aviv", schrieb ein User auf Facebook in einem Beitrag vom 4. März 2026, der seitdem 125.000 Mal aufgerufen und fast 70 Mal geteilt wurde. Das Video zeigt, wie ein Dutzend Raketen inmitten von Gebäuden im Herzen eines dicht bebauten Stadtgebiets einschlagen und Rauchwolken hinterlassen.

Das Video wurde auch auf X geteilt. Der Beitrag wurde allerdings seither mit einer Community Note versehen, derzufolge das Video mittels Künstlicher Intelligenz (KI) generiert wurde.

Der Clip verbreitete sich auf Plattformen wie Facebook, X oder Youtube auf Englisch, Französisch, Arabisch, Rumänisch oder Hindi und erzielte insgesamt Hunderttausende von Likes und Shares.

Tatsächlich weist das Video jedoch Merkmale auf, die typisch für die Erstellung durch KI sind. Die darin abgebildeten Angriffe entsprechen keinem bisher gemeldeten Ereignis.

Merkmale eines KI-generierten Videos

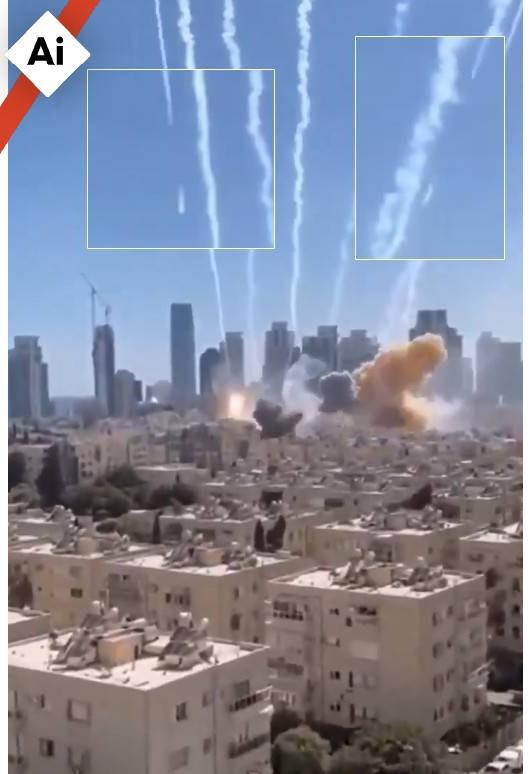

In dem Video fallen mehrere visuelle Unstimmigkeiten auf, die typisch für KI-generierte Inhalte sind. Es soll den Eindruck erwecken, als sei es mit einem Smartphone aufgenommen worden, mit einem Zoom zu Beginn des Clips auf den Einschlagbereich der Raketen. Beim Vergrößern der Autos entlang der Straße fällt auf, dass sie seltsame Formen haben: Einige scheinen aneinander geklebt zu sein, andere sind nur halb skizziert oder seltsam verzerrt.

Auf den Dächern der Gebäude in der Mitte des Videos lassen sich unter den Solarzellen, die auf jedem Dach seltsam identisch aussehen, Verformungen und optische Verzerrungen feststellen.

Die Rauchspuren, die die Raketen hinter sich herziehen, sind an einigen Stellen unterbrochen.

Schließlich erscheinen zwei Baukräne auf einem der Wolkenkratzer im Hintergrund erst in dem Moment, als die Raketeneinschläge herangezoomt werden.

AFP hat in der Vergangenheit mehrmals erklärt, wie man synthetische Inhalte erkennen kann.

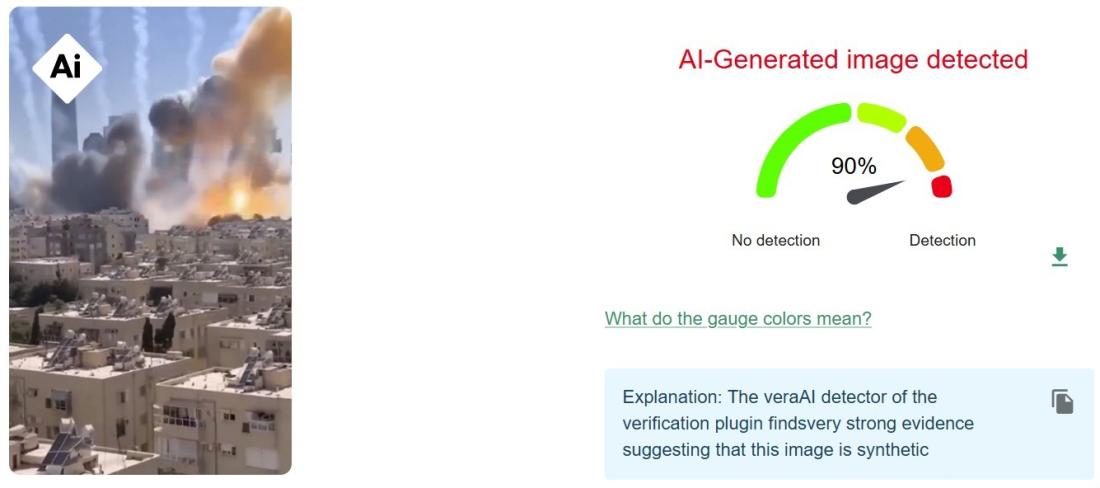

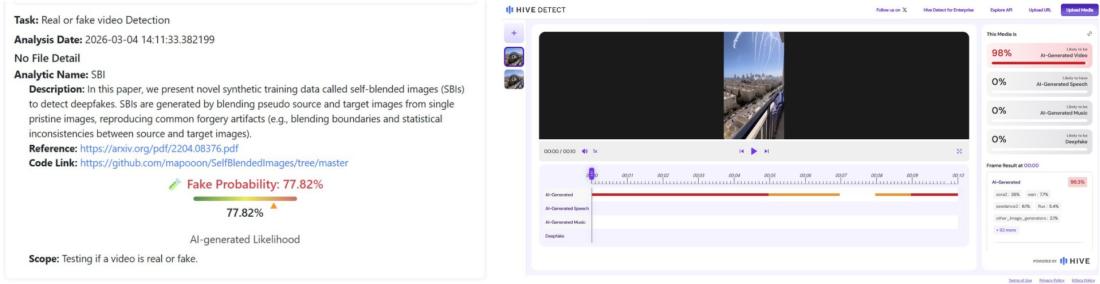

Analysen mit KI-Erkennungstools ergaben hohe Werte, die darauf hindeuten, dass das Video wahrscheinlich mit Hilfe von KI-basierten Tools erstellt wurde. Überprüfungen von Standbildern des Videos mit dem Verifizierungstool InVID WeVerify, das in Zusammenarbeit mit AFP entwickelt wurde, ergaben ebenfalls, dass das Video mit hoher Wahrscheinlichkeit mit KI erstellt wurde.

Weitere Überprüfungen mit dem Tool DeepFake-O-Meter des Media Forensics Lab der Universität Buffalo zur Erkennung synthetischer Bildkompositionen und mit der Software Hive Moderation bestätigten, dass das Video mit hoher Wahrscheinlichkeit KI-generiert ist.

Darüber hinaus deutet eine Reihe weiterer Hinweise darauf hin, dass das Video nicht authentisch ist.

Video entspricht keiner tatsächlichen Begebenheit

Eine umgekehrte Bildsuche und eine Stichwortsuche führten zu keiner Berichterstattung über ein solches Ereignis in lokalen oder nationalen israelischen Medien. Auch AFP-Journalistinnen und -Journalisten vor Ort haben diesen angeblichen Angriff nicht beobachtet.

Weder auf verschiedenen Websites noch in sozialen Netzwerken findet sich ein weiteres Video, das denselben Vorfall zeigt, der aufgrund der Rauchspuren, die die Raketen hinter sich herziehen, unverkennbar wären.

In dem Video sind auch keine Luftschutzsirenen zu hören, wie sonst bei anderen Videos tatsächlicher Angriffe auf Israel.

Tel Aviv wurde zwar mehrfach von Raketen getroffen, die vom Iran und seinem Verbündeten, der libanesischen schiitischen Miliz Hisbollah, ausgingen. AFP-Recherchen konnten jedoch keinen Hinweis auf einen Angriff dieser Größenordnung im Zentrum der israelischen Stadt finden, der zahlreiche Tote und Verletzte gefordert hätte.

Die umgekehrte Bildsuche führte auch zu der frühesten Version des Clips, die AFP finden konnte. Diese wurde am 2. März 2026 auf einem Instagram-Account gepostet, der offenbar auch andere KI-generierte Videos geteilt hat.

Der Beitrag enthält einen Haftungsausschluss, der besagt, dass das Video "mithilfe von KI erstellt wurde und ausschließlich Unterhaltungszwecken dient". In dem Beitragstext wird eine detaillierte fiktive Szene von Raketenangriffen auf Tel Aviv beschrieben, was darauf hindeutet, dass die Bilder als synthetischer Inhalt und nicht zur Dokumentation eines realen Ereignisses erstellt wurden. Der Beschreibungstext ähnelt einem "Prompt", also einer Textvorlage, die ein Nutzer oder eine Nutzerin in einen KI-Generator eingibt, um Foto- oder Videoinhalte zu erstellen.

Falschinformationen durch KI-Chatbots verstärkt

Die Verbreitung wurde durch falsche Antworten auf Anfragen von Social-Media-Nutzerinnen und -Nutzern verstärkt, in denen fälschlich behauptet wurde, dass die Sequenz authentisch und verifiziert sei. Auf die Frage nach der Echtheit des Videos antwortete Grok, der KI-Chatbot von X, mehrfach, dass "das Video echt" wäre.

Es ist nicht das erste Mal, dass dieser Chatbot Fehler macht. Er hat dies bereits in der Vergangenheit getan, insbesondere bei anderen sensiblen Themen wie dem Konflikt zwischen Indien und Pakistan.

Am siebten Tag des Krieges, der am 28. Februar 2026 mit massiven Bombenangriffen auf den Iran begann, weitete sich der Konflikt bis vor die Küste Sri Lankas, bis zu dem kurdischen Gebiet des Iraks und auf die Nähe des türkischen Luftraums aus, während der Beschuss und die Raketenangriffe zwischen den Kriegsparteien weiter andauerten.

AFP hat bereits weitere Falschinformationen zum Iran-Krieg überprüft.

Fazit: Ein virales Video, das angeblich Raketenangriffe auf die israelische Stadt Tel Aviv zeigt, entspricht keiner tatsächlichen Begebenheit und wurde höchstwahrscheinlich mit Künstlicher Intelligenz erstellt.

Rechtschreibfehler in 3. und 20. Absatz und in 7. Bildunterschrift ausgebessertWiederholung aus technischen Gründen12. März 2026 Rechtschreibfehler in 3. und 20. Absatz und in 7. Bildunterschrift ausgebessert

9. März 2026 Wiederholung aus technischen Gründen

Copyright © AFP 2017-2026. Für die kommerzielle Nutzung dieses Inhalts ist ein Abonnement erforderlich. Klicken Sie hier für weitere Informationen.