KI im Fokus: Acht Tipps zum Erkennen von künstlich erstellten Bildern

- Dieser Artikel ist älter als ein Jahr.

- Veröffentlicht am 22. Januar 2025 um 17:02

- 8 Minuten Lesezeit

- Von: AFP Frankreich

- Übersetzung und Adaptierung: Johanna LEHN, AFP Deutschland

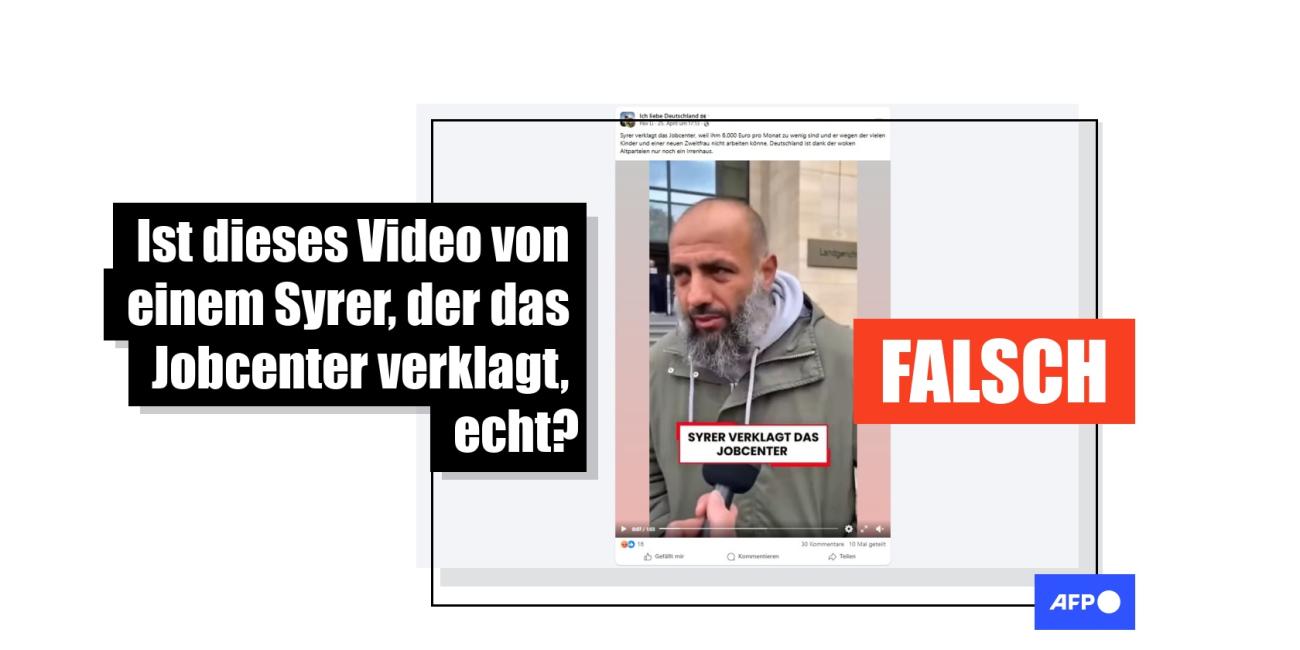

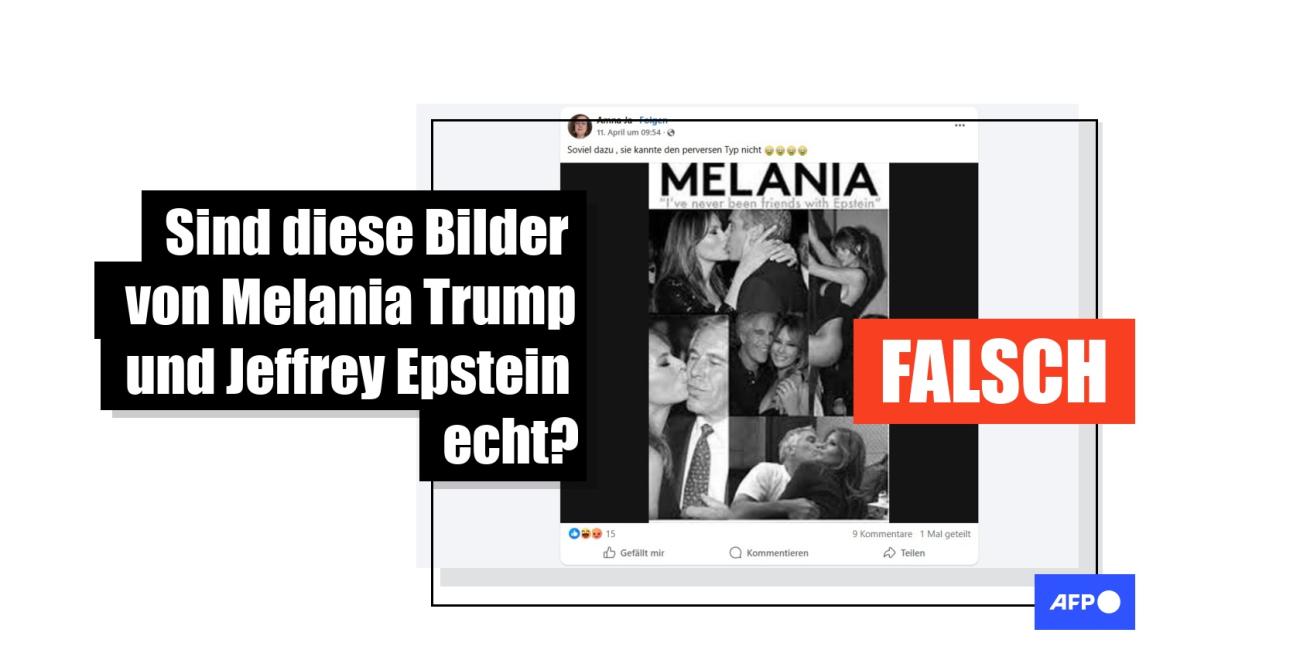

Foto, Video, Audio: ungeachtet ihrer Form verbreiten sich zahlreiche Inhalte in sozialen Netzwerken, die mithilfe künstlicher Intelligenz (KI) generiert wurden. Zu verdanken ist diese Tatsache dem frei verfügbaren Angebot von KI-Programmen wie etwa Midjourney, Dall-E, Imagen oder Synthesia.

Diese wachsende Anzahl KI-generierter Inhalte kann sowohl der Unterhaltung dienen als auch zur Desinformation genutzt werden – insbesondere, wenn die künstlichen Inhalte aus ihrem ursprünglichen Kontext gerissen werden.

Derzeit gibt es kein Programm, dessen Erkennung von KI-generierten Inhalten zu hundert Prozent verlässlich ist. AFP hat jedoch acht Tipps für Nutzerinnen und Nutzer, um KI-generierte Inhalte zu erkennen.

1. Auf den Hinweis "KI-generiert" achten

Einen ersten Anhaltspunkt liefern die Hinweise "KI-generierter Inhalt" oder "mithilfe von KI erstellt" auf einigen Beiträgen in sozialen Medien. Manche Plattformen wie Instagram oder Tiktok fügen dieses Label automatisch hinzu, sobald sie KI-generierte oder mit KI veränderte Inhalte erkennen (hier und hier archiviert).

Auch Nutzerinnen und Nutzer selbst können Inhalte als KI-generiert kennzeichnen, wenn sie sie veröffentlichen.

Allerdings sind nicht alle künstlich erstellten Bilder und Videos automatisch mit diesem Label versehen. Umgekehrt ist es auch möglich, dass ein authentisches Foto fälschlicherweise als KI-generiert gekennzeichnet wird.

2. Die Quelle überprüfen

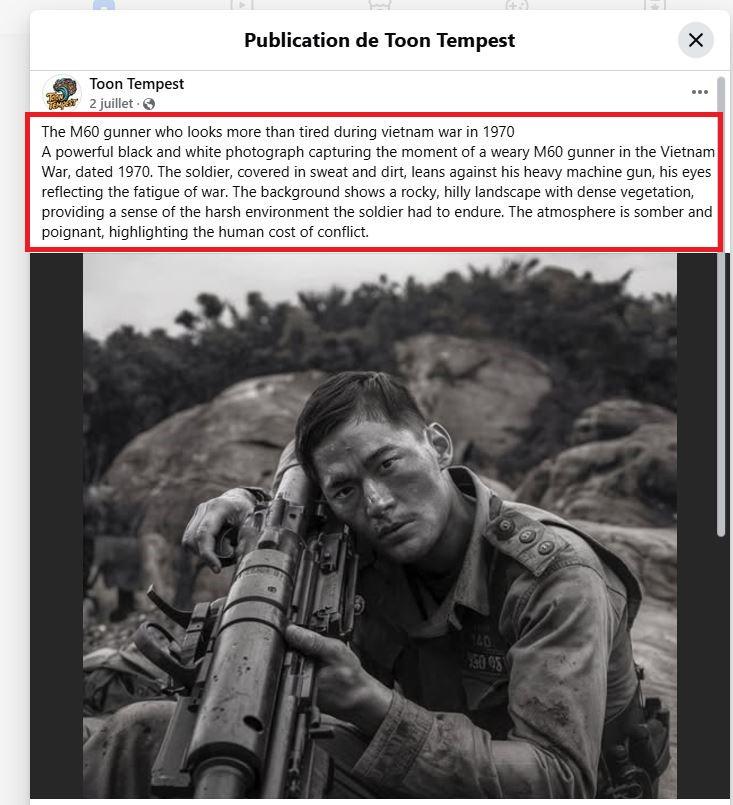

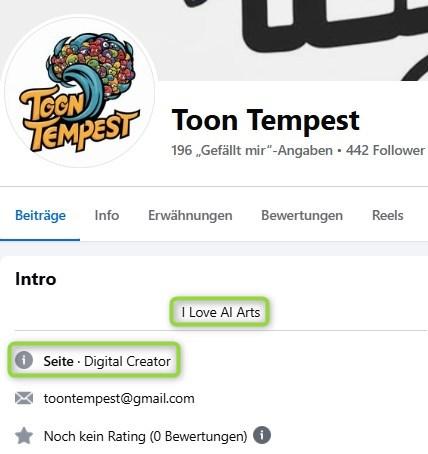

Ein erschöpfter Soldat stützt sich in einem kurzen Moment der Ruhe mitten im Vietnamkrieg auf seine Waffe – so realistisch dieses Bild, das auf Facebook geteilt wird, auch sein mag, es ist mit einer KI erstellt worden.

Mehrere Elemente weisen darauf hin. Zuerst fällt der Text zum Bild auf, der nichts anderes ist als die Anweisung an die KI, der sogenannte Prompt, wie sie das Bild erstellen sollte.

Zudem geben die Informationen zur Facebook-Seite, auf der das Bild hochgeladen wurde, einige Hinweise. Darin heißt es "I Love AI Arts", außerdem wird sie als "Digital Creator", also eine Seite für digitale Gestaltung, bezeichnet. Auch in anderen Beiträgen dieser Seite sind die Prompts für die KI-generierten Bilder zu lesen.

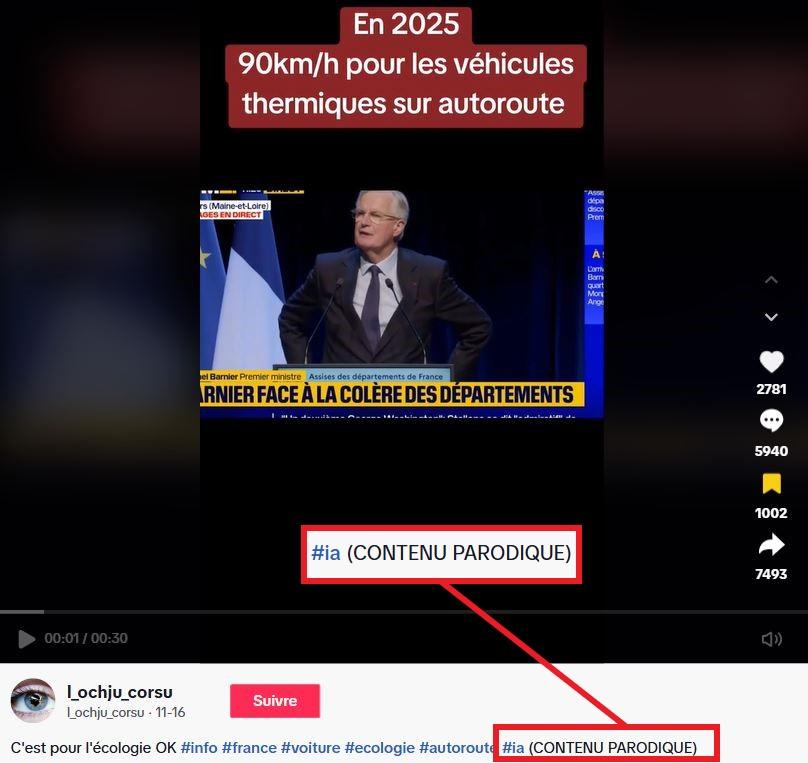

Dasselbe gilt für ein Video, in dem der ehemalige französische Premierminister Michel Barnier anzukündigen scheint, dass die zulässige Höchstgeschwindigkeit für Fahrzeuge mit Verbrennungsmotor auf Autobahnen auf 90 Stundenkilometer abgesenkt werde. Auch wenn einige Nutzerinnen und Nutzer zu glauben schienen, dass es sich um eine neue Maßnahme der Regierung handelte, wurde im Originalpost deutlich, dass es eine Parodie war. Im Ursprungsbeitrag wurde zudem der französische Hashtag für künstliche Intelligenz "IA" verwendet.

Auch in der Profilbeschreibung des Nutzers findet sich ein Hinweis auf Inhalte, die mit künstlicher Intelligenz erstellt oder bearbeitet wurden.

3. Weitere "Informationen" überprüfen

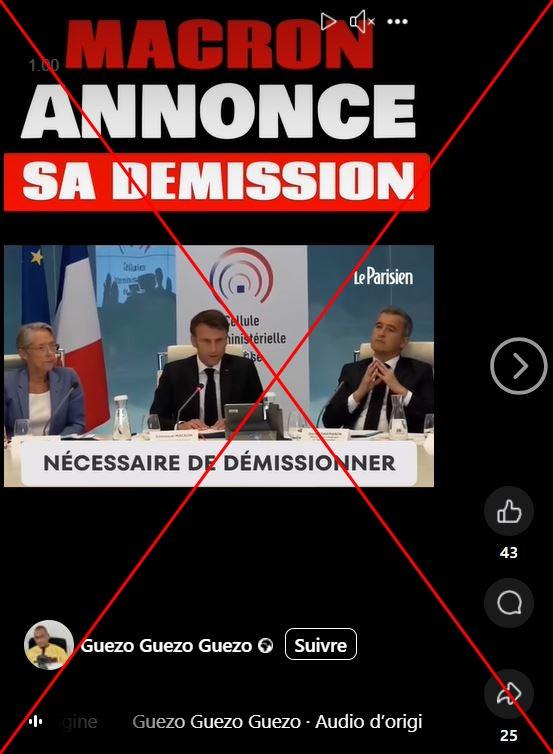

In der Beschreibung eines anderen Videos von September 2023 wird behauptet, der französische Präsident Emmanuel Macron sei zurückgetreten. In der Sequenz spricht scheinbar nur Macron. Eine Stimme, die wie seine eigene klingt, scheint seinen Rücktritt zu erklären. Angeblich hätte die Unzufriedenheit in der französischen Bevölkerung mit seiner Regierung ihn dazu veranlasst, "die schwere aber notwendige Entscheidung zu treffen, von seinem Amt als Präsident der Republik zurückzutreten". Insbesondere durch Pfiffe bei der Eröffnungsfeier der Rugby-Weltmeisterschaft 2023 in Frankreich sei diese Unzufriedenheit zum Ausdruck gekommen.

Über ein solches Ereignis wäre allerdings von zahlreichen Medien berichtet worden.

Eine einfache Stichwortsuche zeigt, dass eine solche Ankündigung von Macron nicht stattgefunden hat. Dank verschiedener Hinweise im Video wie dem Schriftzug der französischen Tageszeitung "Le Parisien" und des Datums 30. Juni 2023 lässt sich zudem das Originalvideo ausfindig machen, dem die falsche Tonspur hinzugefügt wurde.

In einem französischem Faktencheck von September 2023 über das Video erläuterte AFP, dass die Tageszeitung das Video am Nachmittag des 30. Juni 2023 veröffentlichte. Es wurde bei einer Sitzung des interministeriellen Krisenstabs gefilmt, dessen Logo auch im Hintergrund des Videos zu sehen ist. Er wurde eingerichtet, um auf die Unruhen nach dem Tod des Jugendlichen Nahel zu reagieren, der am 27. Juni 2023 bei einer Polizeikontrolle im Pariser Vorort Nanterre getötet worden war.

Macron verurteilte in dieser Sitzung die Straßengewalt und kündigte mehr Polizeimaßnahmen an, um solchen Ereignissen ein Ende zu bereiten. Diese Aussagen standen in keinem Zusammenhang mit einem möglichen Rücktritt des Präsidenten.

4. "Zu perfekte" Bilder

Ein Baby, das Gitarre spielt, oder ein Heranwachsender, der seinen Geburtstag feiert: solche auf Facebook geteilten Fotos erscheinen in einer makellosen Ästhetik und rufen zahlreiche enthusiastische Kommentare hervor. Bei genauerer Betrachtung fällt jedoch auf, dass Haut und Haare der Personen sehr glatt und wenig natürlich erscheinen.

Jedes dieser Fotos weist zudem Fehler auf, die sie als KI-generiert entlarven: Das Baby hat nur vier Finger, auf der Wimpelkette ist "Happy Birthday" falsch geschrieben.

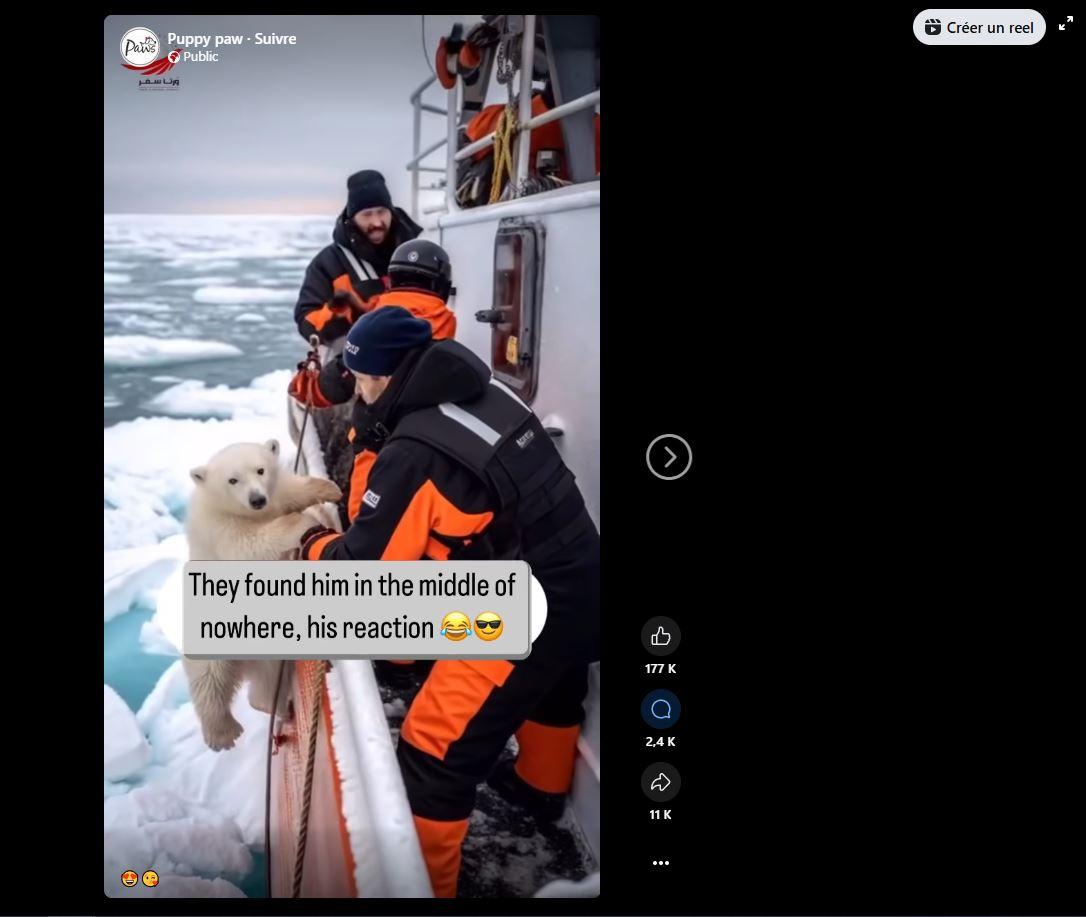

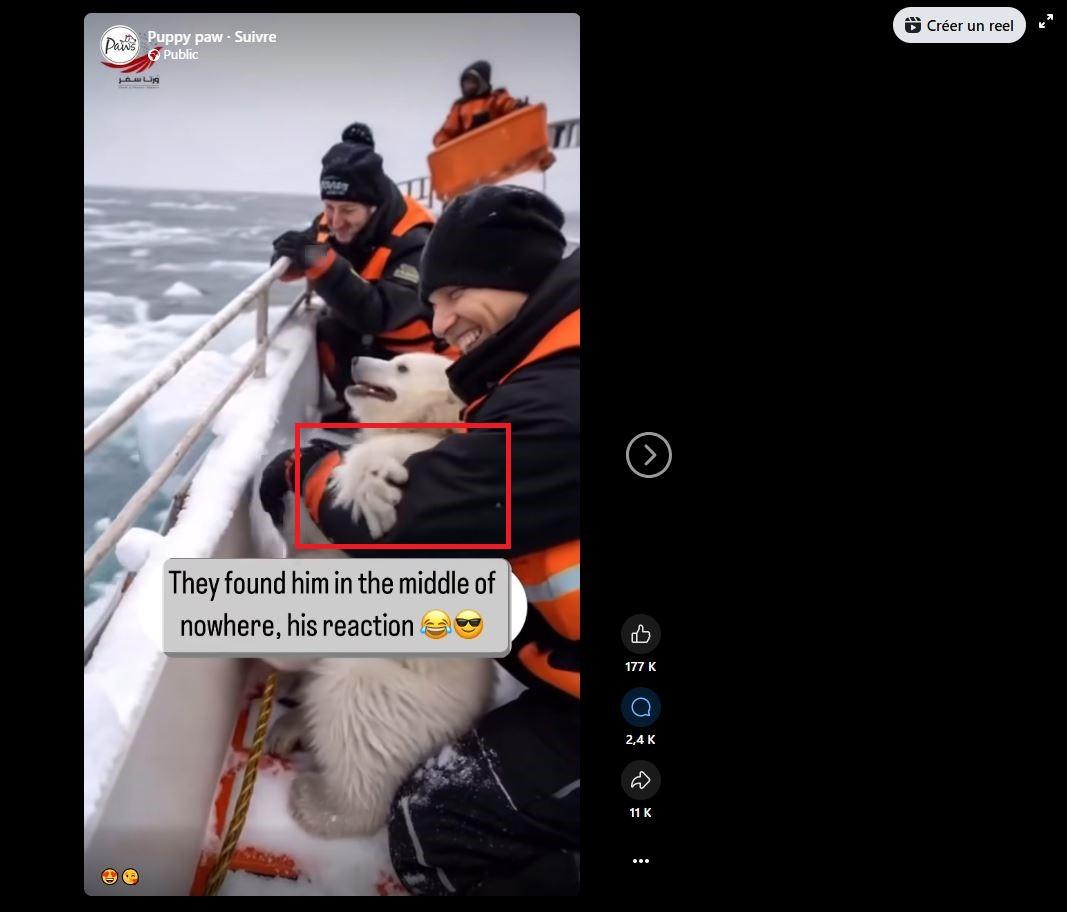

Gleiches gilt für ein virales Video, das angeblich zeigt, wie Seeleute mit einem Eisbärbaby kuscheln, das sie auf der Überfahrt gefunden haben.

Die bewegenden Aufnahmen spielen mit den Emotionen der Nutzerinnen und Nutzer. Sie sind jedoch nicht authentisch, wie der "zu perfekt" aussehende Eisbär zeigt sowie die Tatsache, dass seine Tatzen kurzzeitig wie menschliche Hände aussehen.

5. Den Bildhintergrund betrachten

War während der berühmten Parade zu Thanksgiving in New York ein riesiger Ballon in der Form von Donald Trump zu sehen? Die Umgebung rund um den Ballon gibt den Betrachterinnen und Betrachtern einige Hinweise darauf, dass das online verbreitete Bild KI-generiert wurde.

Zunächst fällt auf, dass die Gesichter der Passantinnen und Passanten unvollständig oder verformt sind. Außerdem wird der Ballon unrealistischerweise von nur wenigen Personen gehalten, die angesichts seiner Größe kaum dazu in der Lage sein dürften.

6. Auf historische Ungereimtheiten achten

"Einweihung des Eiffelturms 1889", heißt es in der Beschreibung eines schwarz-weiß-Bildes auf Facebook. Allerdings sind mehrere Personen in der Menschenmenge zu sehen, die die Sehenswürdigkeit mit einem Smartphone fotografieren. Manchmal reicht der gesunde Menschenverstand aus, um ein KI-generiertes Bild als solches zu erkennen.

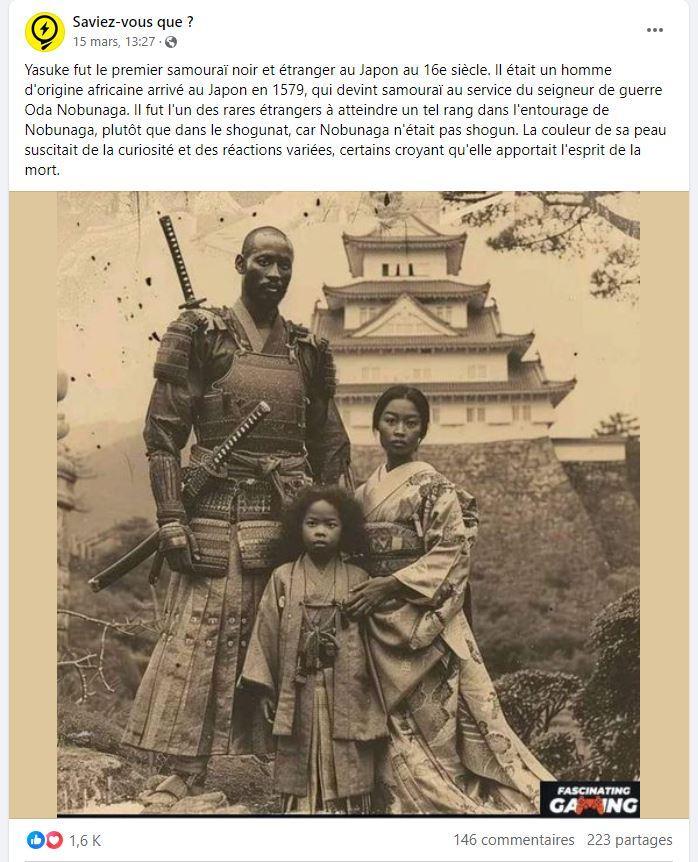

Gleiches gilt für ein angebliches Foto des Schwarzen Samurais Yasuke, der im 16. Jahrhundert in Japan lebte – nur, dass die Fotografie erst im 19. Jahrhundert erfunden wurde und eine solche Aufnahme unmöglich ist.

Wie unter anderem Julien Peltier, ein auf Samurai spezialisierter Autor, im März 2024 gegenüber AFP zur Darstellung des Kriegers erklärte, ist es "sehr schwierig, um nicht zu sagen unmöglich, eine Waffe zu ziehen, die auf dem Rücken positioniert ist. Man sieht diese Pose nur in Mangas, Hollywoodfilmen und in der Popkultur." Außerdem trage der Samurai die Waffe auf der falschen Seite, da sie normalerweise links getragen werde. Auch die Klinge selbst sei untypisch und "nicht repräsentativ für die Form des japanischen Schwertes", erklärte er weiter.

7. Manipulierte Tonspur erkennen

Macron, der Arabisch spricht? Das scheint ein häufig geteiltes Video zu zeigen, in dem der französische Präsident angeblich angekündigt habe, Arabisch "ab dem Kindergarten" in den Unterricht integrieren zu wollen. Dabei handelt es sich um ein Deepfake, also einen Audio- oder Videoinhalt, der mithilfe von KI manipuliert wurde, um eine Person etwas sagen zu lassen, das sie nicht gesagt hat.

Wenn man aufmerksam zuhört, stellt man fest, dass die Audiospur KI-generiert ist. Die Stille im Hintergrund, obwohl Macron die Rede vor Publikum im Freien hält, ist ein wichtiger Hinweis. Zudem klingt seine Atmung leicht roboterhaft. Des Weiteren sind die Bewegungen seiner Lippen mitunter unnatürlich und stimmen nicht mit den Worten überein, die er zu sagen scheint.

8. Umgekehrte Bildsuche nutzen

Ein Bild eines Flugzeugs, das nahe einer starken Explosion am Flughafen von Beirut im Libanon zu landen scheint, wurde im Herbst 2024 vielfach geteilt und kommentiert. Es wurde im Zusammenhang mit den Angriffen der israelischen Armee auf Finanzinstitute in der libanesische Hauptstadt am 20. Oktober 2024 verbreitet, die mit der Hisbollah-Miliz in Verbindung stehen.

Eine umgekehrte Bildsuche, kombiniert mit einer Stichwortsuche, führte zu dem geteilten Bild auf mehreren Instagram-Accounts, die erwähnen, dass es KI-generiert sei. Die umgekehrte Bildsuche hat den zusätzlichen Vorteil, dass sie ähnliche Veröffentlichungen anzeigt, wie AFP bereits im März 2023 erklärte. Das kann wertvoll sein, um ein mutmaßlich KI-generiertes Bild mit ähnlichen Bildern aus vertrauenswürdigen Quellen zu vergleichen.

Im Zusammenhang mit einem medienwirksamen Treffen des russischen Präsidenten Wladimir Putin mit dem chinesischen Staatschef Xi Jinping kursierte ein Bild ohne Quellenangabe, das Putin vor Xi kniend zeigt. Wie der italienische Journalist David Puente hervorhob, unterschied sich der Hintergrund auf diesem vermeintlichen Foto stark von dem Hintergrund auf Bildern des Events, die von anderen Medien stammten. Diese Unstimmigkeit ließ Zweifel an der Authentizität des viel geteilten Bildes aufkommen.

Copyright © AFP 2017-2026. Für die kommerzielle Nutzung dieses Inhalts ist ein Abonnement erforderlich. Klicken Sie hier für weitere Informationen.