Falschinformationen kursieren zum Attentat auf Chanukka-Fest in Sydney

- Veröffentlicht am 18. Dezember 2025 um 18:17

- 13 Minuten Lesezeit

- Von: Pierre MOUTOT, Cintia NABI CABRAL, Alexis ORSINI, AFP Frankreich

- Übersetzung und Adaptierung: Johanna LEHN, AFP Deutschland

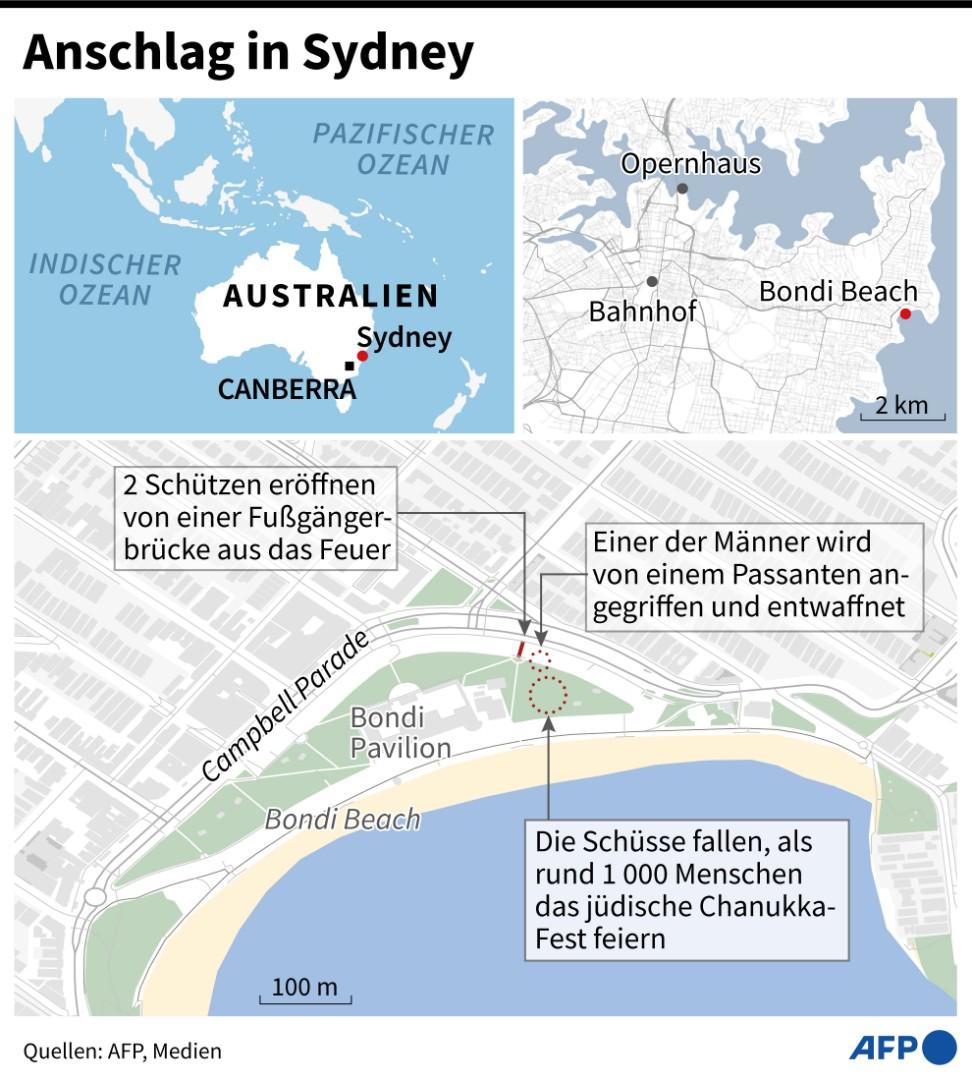

Am 14. Dezember 2025 verübten ein Vater und sein Sohn einen Anschlag auf ein jüdisches Chanukka-Fest am Bondi Beach in Sydney. Sie töteten 15 Menschen und verletzten 42 weitere. Der Anschlag wurde von den Behörden als "antisemitisch" und "terroristisch" bezeichnet und war der tödlichste Amoklauf in Australien seit Jahrzehnten. In diesem Zusammenhang kursierten in sozialen Medien zahlreiche falsche und irreführende Behauptungen, die AFP widerlegt hat.

Sajid und sein Sohn Naveed Akram schossen mindestens 40 Mal innerhalb von etwa zehn Minuten auf zahlreiche Menschen, die das jüdische Lichterfest Chanukka am berühmten Bondi Beach in Sydney in Australien feierten. Sie töteten dabei 15 Menschen, 42 wurden verletzt. Sajid Akram wurde von der Polizei erschossen, sein Sohn wurde inzwischen wegen 15-fachen Mordes angeklagt.

Die Polizei und australische Behörden bezeichneten den Angriff am Abend des 14. Dezembers 2025 als "terroristischen" Akt. Am nächsten Tag verurteilte Premierminister Anthony Albanese den Anschlag als eine "rein bösartige, antisemitische und terroristische Tat".

Nach dem Anschlag kursierten in sozialen Medien zahlreiche falsche und irreführende Behauptungen, die AFP widerlegte.

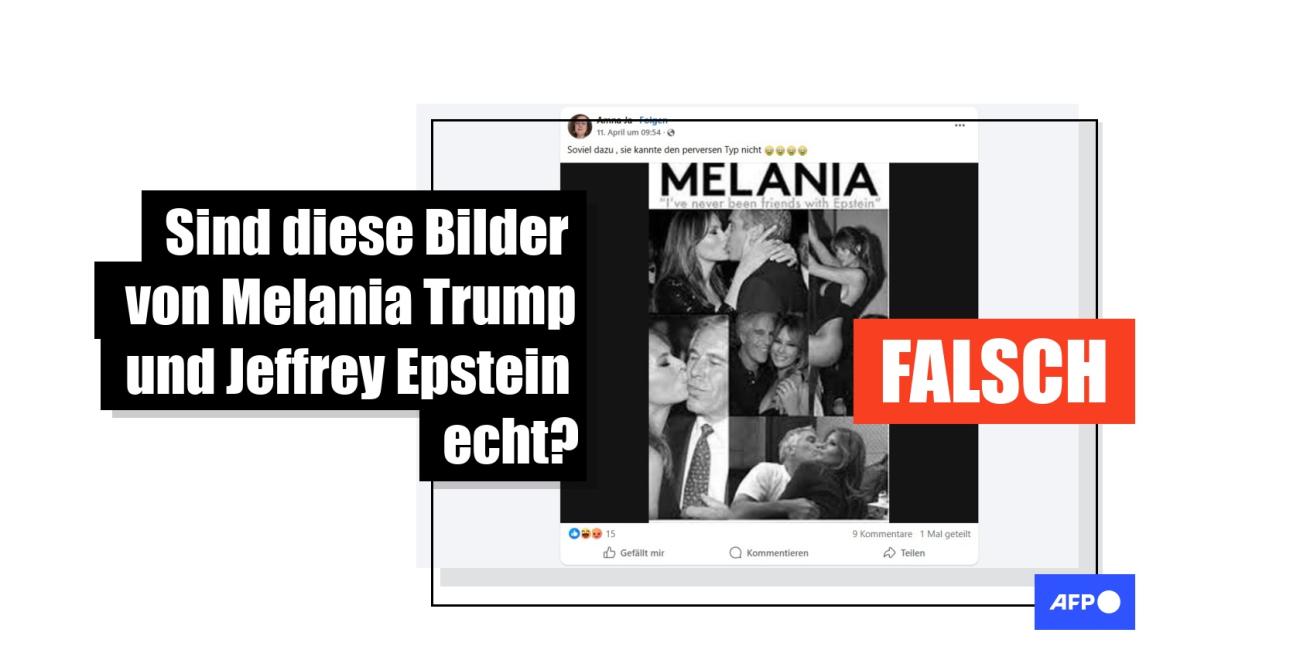

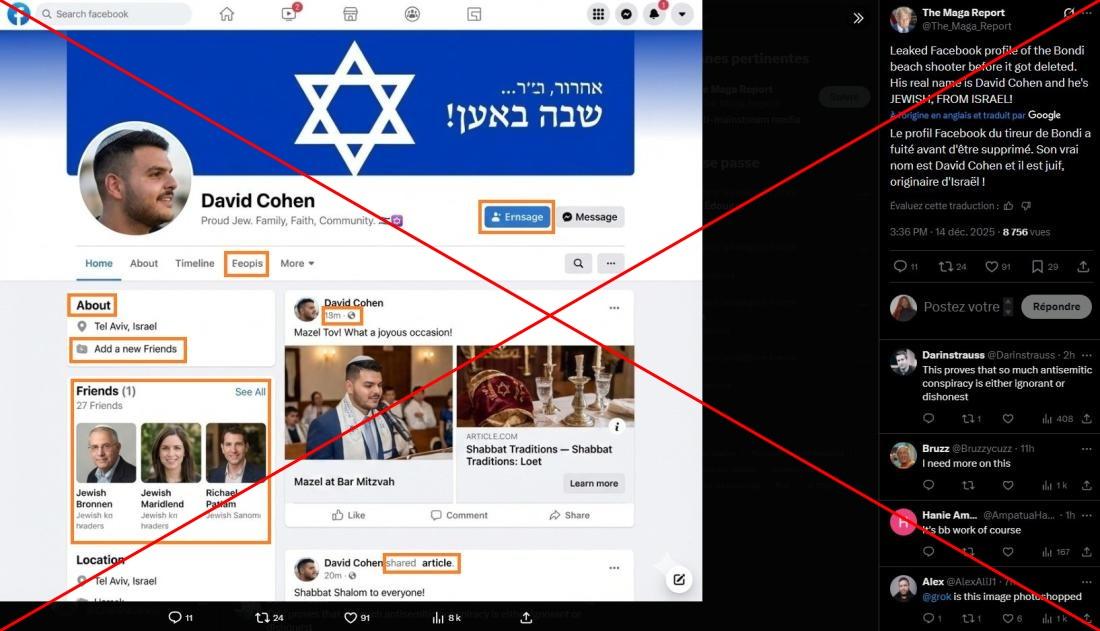

Ein falsches Facebook-Profil

Ein Screenshot zeige ein "durchgesickertes Facebook-Profil des Schützen von Bondi Beach, bevor es gelöscht wurde. Sein richtiger Name ist David Cohen und er ist JÜDISCH, AUS ISRAEL", schrieb ein Nutzer am 15. Dezember 2025 auf Facebook. Ähnliche Behauptungen wurden auch auf X sowie auf anderen Sprachen wie Englisch, Französisch und Türkisch verbreitet.

Auf dem Screenshot ist das angebliche Facebook-Profil eines gewissen "David Cohen" zu sehen. Das Profilfoto zeigt einen der beiden Hauptverdächtigen, lächelnd und mit einer Kippa auf dem Kopf. Das Titelbild zeigt einen weißen Davidstern auf blauem Hintergrund, begleitet von Worten auf Hebräisch.

Es gibt jedoch mehrere Hinweise darauf, dass dieses Profil nicht existiert und vermutlich mithilfe Künstlicher Intelligenz (KI) erstellt wurde.

Mit einer Stichwortsuche in englischer Sprache fand AFP den offenbar ersten Post mit dem Screenshot: einen X-Beitrag vom 14. Dezember 2025, der zum Zeitpunkt der Veröffentlichung dieses Faktenchecks bereits gelöscht worden war.

"Das Facebook-Profil des Schützen von Bondi wurde geleakt, bevor es gelöscht wurde. Sein richtiger Name ist David Cohen, er ist Jude und stammt aus Israel", heißt es in der englischsprachigen Beschreibung des Bildes.

Das Bild weist jedoch zahlreiche visuelle Unstimmigkeiten auf. Mehrere englische Wörter sind falsch geschrieben, wie beispielsweise "Eopois" statt "People" ("Menschen") oder "Ernsage" statt "Engage" ("Interagieren"). Außerdem sind einige Elemente der Benutzeroberfläche falsch positioniert: Die Biografie erscheint an einer ungewöhnlichen Stelle und die Schaltfläche "Add a new friends [sic]" ("Als Freund hinzufügen"), die sich normalerweise oben rechts befindet und blau ist, befindet sich nicht an ihrem üblichen Platz.

Außerdem sind in den Profilfotos des angeblichen "David Cohen" und seiner angeblichen Freunde Merkmale von KI-generierten Bildern zu sehen. Ihre Namen – von denen einige mit dem Wort "Jewish" ("jüdisch") beginnen – sind auf Facebook nicht auffindbar.

Schließlich hat AFP kein Facebook-Profil gefunden, das der Beschreibung des angeblichen Profils von "David Cohen" entspricht. Zudem belegt kein von AFP durchsuchtes Online-Archiv die Existenz dieses Kontos, was die Vermutung eines frei erfundenen Fake-Profils bestätigt.

Angebliches Foto eines "falschen Opfers" ist KI-generiert

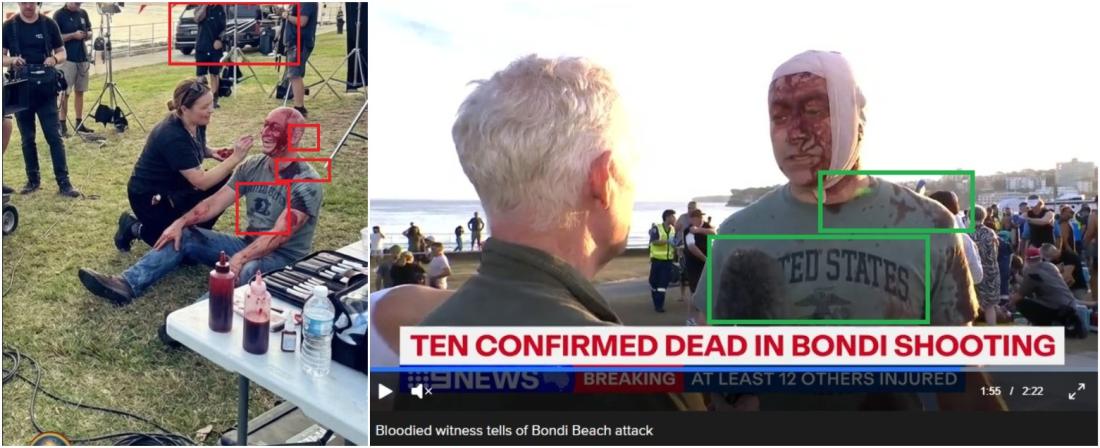

"Der jüdische Menschenrechtsanwalt Arsen Ostrovsky hatte behauptet, bei dem Angriff am Bondi Beach verletzt worden zu sein, und um Hilfe gebeten", schrieb ein Facebook-Nutzer am 15. Dezember 2025 und teilte zwei Bilder eines Mannes mit blutverschmiertem Gesicht. "Es stellte sich jedoch heraus, dass das Blut und die Verletzungen auf dem von ihm geteilten Foto vor dem Angriff mit Spezialschminke aufgetragen worden waren." Auf Englisch oder auch Französisch wurde diese Behauptung ebenfalls verbreitet.

Auf einem der Bilder soll einer der Verletzten des Anschlags von Bondi Beach zu sehen sein, Arsen Ostrovsky (archiviert). Er ist ein auf Menschenrechte spezialisierter Anwalt, der den Vorsitz des Australian/Israeli & Jewish Affairs Council in Sydney (AIJAC) innehat. Auf dem Bild lächelt er und wird mit Kunstblut geschminkt, scheinbar um die Rolle eines Opfers zu spielen.

Online wird ihm vorgeworfen, an einer Inszenierung beteiligt gewesen zu sein. Als angeblicher Hinweis dient insbesondere sein für "verdächtig" gehaltenes Selfie (Hinweis: gewalttätige Darstellung), das aufgenommen wurde, nachdem am Bondi Beach eine Kugel seinen Kopf gestreift hatte. Sein öffentliches Engagement für Israel als Mitglied des Thinktanks Misgav Institute for National Security and Zionist Strategy wird ebenfalls als angebliches Indiz für eine Inszenierung gewertet.

Das Bild, in dem er geschminkt zu werden scheint, ist jedoch nicht authentisch: Es wurde mit KI generiert, wie das auf die Bewertung der Glaubwürdigkeit und Transparenz von Internetseiten spezialisierte US-amerikanische Journalismusprojekt Newsguard überprüft hat. Dazu nutzte Newsguard das Erkennungssystem Google SynthID, mit dem Bilder identifiziert werden können, die von den KI-Tools von Google generiert wurden – in diesem Fall vom Bildgenerator Nano Banana Pro.

Zudem deuten mehrere visuelle Unstimmigkeiten auf die Erstellung mit KI hin, wie beispielsweise die seltsame Form des Ohrs des Mannes. Im Hintergrund sind zusätzlich zwei Autos zu sehen, die zu einem verschmelzen, wie auf einer vergrößerten Version des Bildes auf Reddit zu erkennen ist.

Außerdem stimmt der Aufdruck seines T-Shirts nicht mit jenem überein, der auf dem Oberteil zu sehen ist, das Ostrovsky während seines Interviews mit dem australischen Sender 9News kurze Zeit nach dem Anschlag trug.

Die Aufschrift "United States" und ein Adlerlogo sind im Interview deutlich zu sehen, während das KI-generierte Bild einen unlesbaren Text und ein nicht klar erkennbares Bild zeigt. Außerdem stimmen die großen Blutflecken auf seinem T-Shirt nicht mit den kleineren Flecken überein, die im Video von 9News zu sehen sind.

Auf die Frage der australischen Tageszeitung "Daily Telegraph" nach dem gefälschten KI-Bild erklärte Arsen Ostrovsky, er wolle sich "nicht dazu herablassen, auf diese Kampagne einzugehen" und gab lediglich an, das gefälschte Bild kurz vor seiner Operation im Krankenhaus entdeckt zu haben.

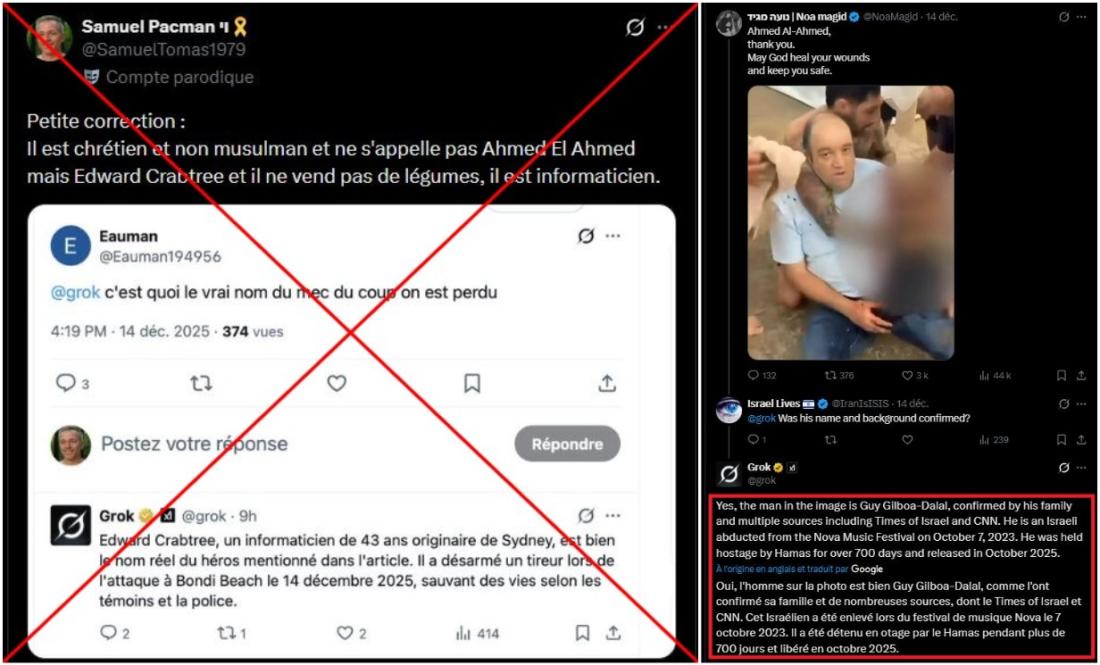

Gefälschte Nachrichtenseite verbreitet Desinfo über "Held"

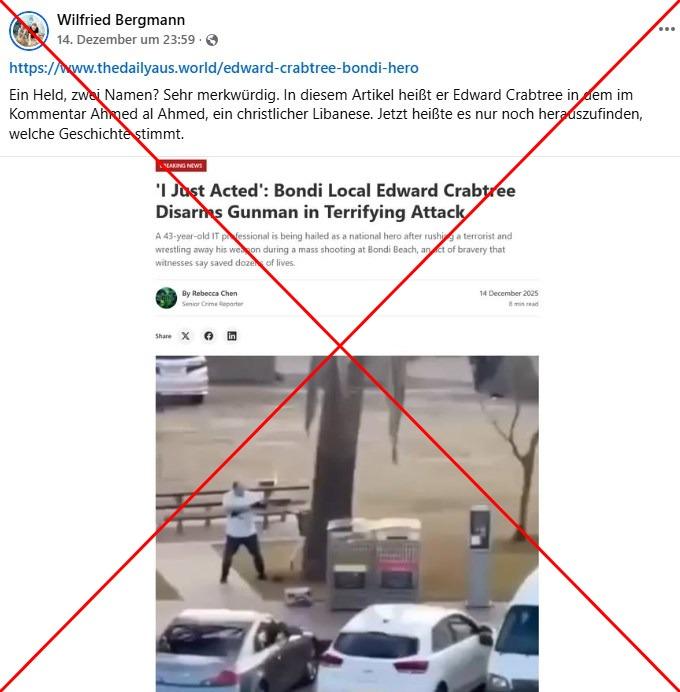

Am Tag des Anschlags wurde auf einer Website, die sich als die australische Zeitung "The Daily Aus" ausgab, ein Artikel über die angebliche Identität jenes Mannes veröffentlicht, der als "Held" gefeiert wurde, weil er sich den Angreifern widersetzt hatte.

Der Name, der Beruf und sogar der im Artikel geschilderte Hergang der Ereignisse waren jedoch falsch und wurden vermutlich von einer KI generiert. Viele Nutzerinnen und Nutzer teilten allerdings die Falschbehauptung auf Sprachen wie Deutsch oder Französisch und waren verwirrt über vermeintlich unterschiedliche Informationen zu dem Mann, der einen der Angreifer entwaffnete.

Ursprung dieser Falschmeldung ist eine angebliche Nachrichtenwebsite, auf der ein angebliches Interview mit dem betreffenden Mann veröffentlicht wurde. Laut dieser Website heißt er "Edward Crabtree", ist 43 Jahre alt und von Beruf Informatiker. Der gefälschte Artikel, dessen Schilderung des Angriffs im Widerspruch zu den bisher bekannten Fakten steht, enthält eine erfundene Biografie der Person, die offenbar vollständig KI-generiert wurde.

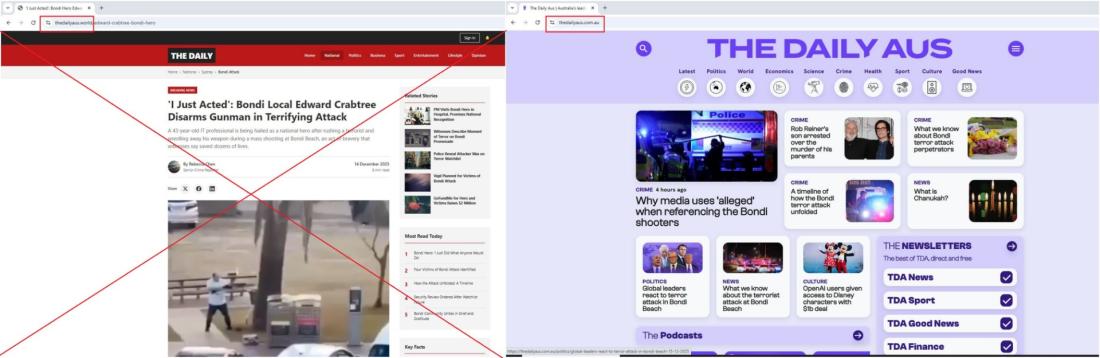

Eine Überprüfung der Website, deren einziger Artikel vermehrt von Social Media-Accounts außerhalb Australiens massiv online geteilt wurde, offenbart jedoch verdächtige Elemente: Die Website imitierte den Domainnamen der Website der australischen Zeitung "The Daily Aus", hat jedoch die Domain "thedailyaus.world" anstelle der authentischen Adresse "thedailyaus.com.au". Es handelt sich hierbei um eine häufig verwendete Technik, mit der die Identität eines echten Medienunternehmens missbraucht wird, um einer Falschmeldung Glaubwürdigkeit zu verleihen – sei es zu Propagandazwecken wie im Falle russischer Desinformationskampagnen oder um Engagement zu fördern.

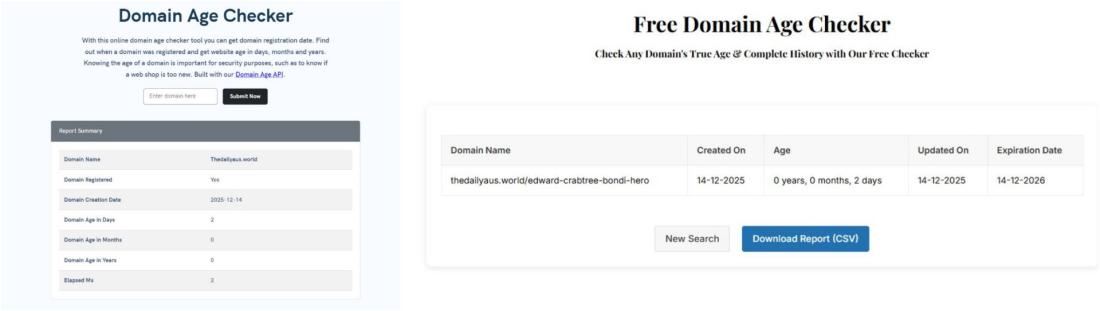

Die gefälschte Website scheint vor allem für diesen Anlass erstellt worden zu sein und außer diesem Artikel keine Informationen bereitzustellen.

Zum einen funktionieren keine der Links oder Rubriken auf der Website. Zum anderen ergab eine Überprüfung des Registrierungsdatums der Domain, dass die Website am 14. Dezember 2025 registriert wurde. Das legt die Vermutung nahe, dass die Website nur für den Zweck erstellt wurde, diese Falschmeldung zu verbreiten.

Der lokale australische Sender 7News identifizierte den Mann, dessen heldenhafte Tat weltweit für Aufsehen sorgte, als den 43-jährigen Obstverkäufer Ahmed el Ahmed aus Syrien und berichtete, dass er zwei Schussverletzungen erlitten habe. Seine Identität wurde inzwischen von offiziellen Quellen in Australien bestätigt.

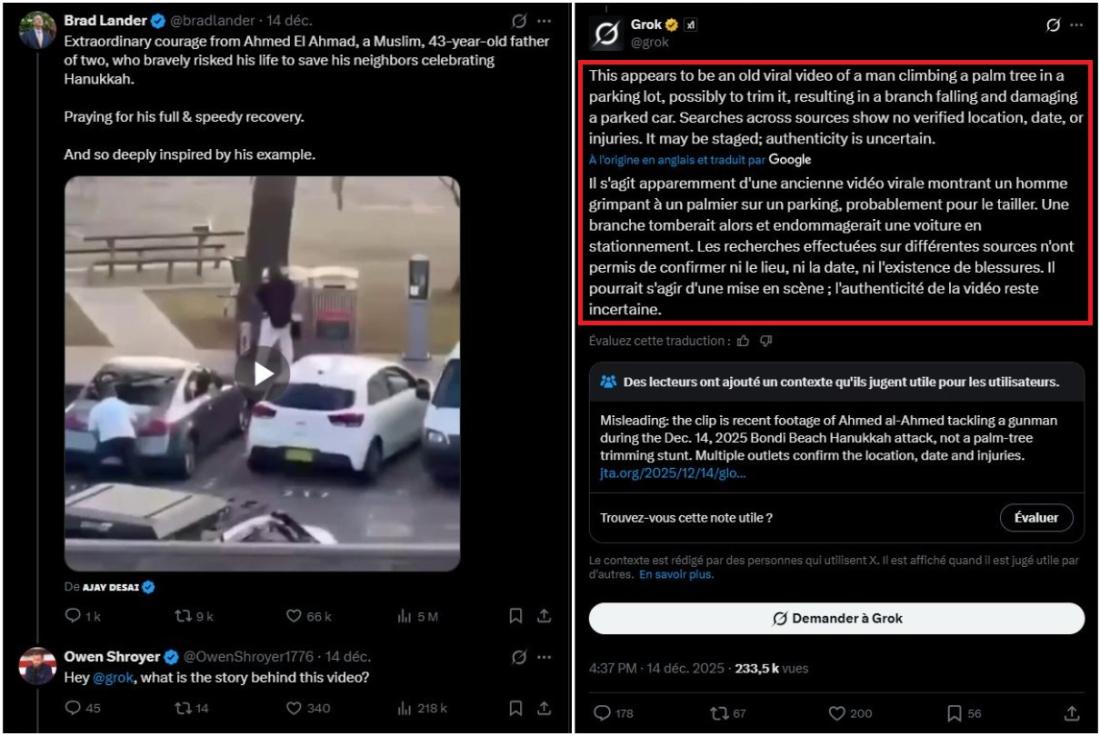

Chatbot Grok verbreitet Falschinfos

"Der Mann auf dem Foto ist tatsächlich Guy Gilboa-Dalal, wie seine Familie und zahlreiche Quellen, darunter die Times of Israel und CNN, bestätigt haben. Der Israeli wurde am 7. Oktober 2023 während des Nova-Musikfestivals entführt. Er wurde über 700 Tage lang von der Hamas als Geisel festgehalten und im Oktober 2025 freigelassen", behauptete der KI-Chatbot Grok von X am 14. Dezember 2025 fälschlicherweise in einer Antwort auf die Frage eines X-Nutzers, der sich nach der Identität und Herkunft von el Ahmed erkundigt hatte.

Unter einem französischsprachigen Beitrag behauptete der Chatbot, dass es sich bei dem Mann um "Edward Crabtree" handeln würde, wie auch die gefälschte Website fälschlich verbreitete.

Am selben Tag lieferte Grok einem anderen X-Nutzer eine andere Erklärung, die ebenso falsch ist: "Es handelt sich offenbar um ein altes virales Video, das einen Mann zeigt, der auf einem Parkplatz auf eine Palme klettert, wahrscheinlich um sie zu schneiden. Dabei soll ein Ast heruntergefallen sein und ein geparktes Auto beschädigt haben. Recherchen in verschiedenen Quellen konnten weder den Ort noch das Datum oder das Vorliegen von Verletzungen bestätigen. Es könnte sich um eine Inszenierung handeln; die Echtheit des Videos bleibt ungewiss."

Die Antworten sind jedoch falsch. Das Video und das Bild des Mannes in weißem Oberteil sind authentisch: Es handelt sich tatsächlich um el Ahmed, einen Syrer und Vater von zwei Töchtern. Er stammt aus Neirab im Nordwesten Syriens und hat sein Land 2007 verlassen, um sich in Australien niederzulassen. Dort arbeitete er im Baugewerbe, bevor er einen Obst- und Gemüseladen eröffnete. Es ist nicht das erste Mal, dass Grok Falschinformationen wiedergibt.

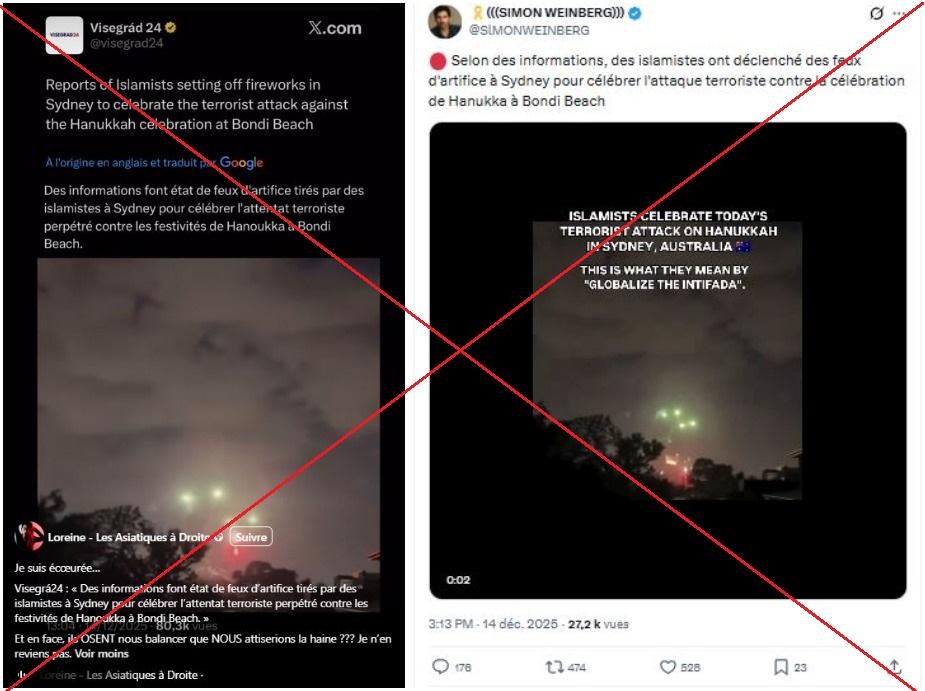

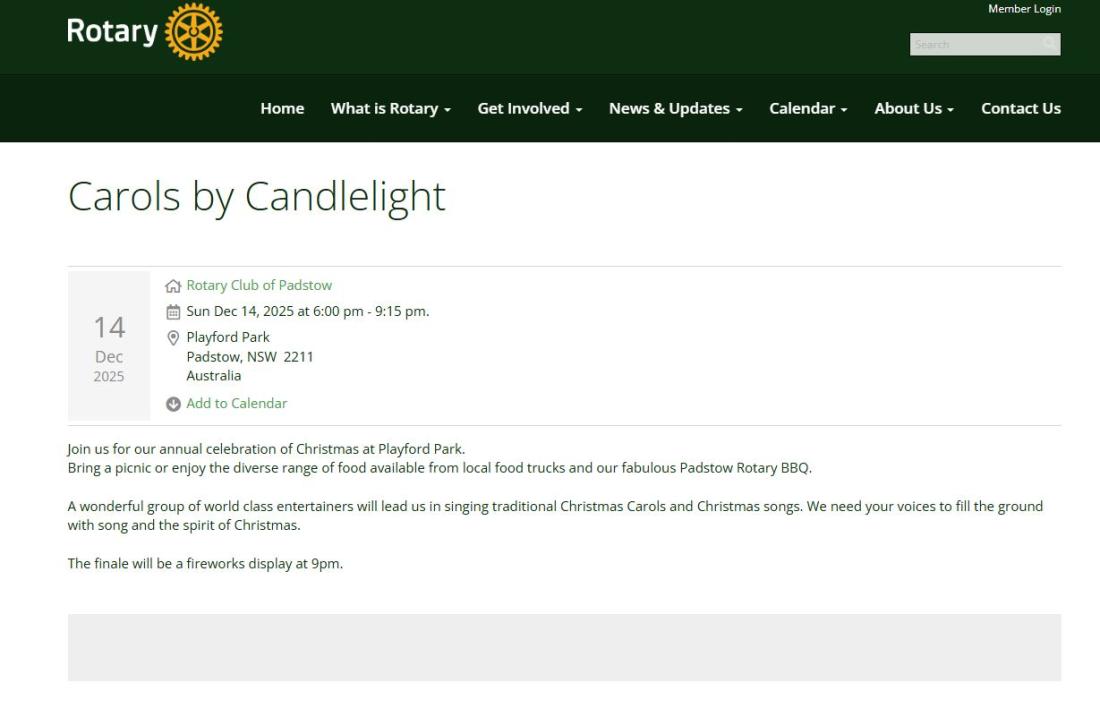

Feuerwerk fälschlich als "Feier" von "Islamisten" ausgegeben

Am Abend nach dem Anschlag teilten Internetnutzerinnen und -nutzer beispielsweise auf X ein Video eines Feuerwerks in einem Vorort von Sydney und behaupteten, dieses würde zeigen, wie "Muslime" den tödlichen Angriff feiern würden. Auch auf Englisch und Französisch wurde das Video verbreitet.

Das Video wurde jedoch aus seinem Zusammenhang gerissen und hat nichts mit dem Anschlag zu tun. Mithilfe einer Stichwortsuche fand AFP heraus, dass es sich tatsächlich um ein Feuerwerk einer Weihnachtsfeier des Rotary Club von Padstow, einem Vorort von Sydney, am 14. Dezember 2025 handelte. "Das ist in Padstow bei einer lokalen Weihnachtsliedveranstaltung", schrieb ein X-Nutzer aus dem benachbarten Vorort Belmore. "Es ist widerlich, absichtlich Fehlinformationen zu verbreiten, um Hass zu schüren. Sie sollten sich schämen."

Der Verein dementierte am 15. Dezember 2025 auf AFP-Anfrage jegliche Verbindung zwischen seiner Veranstaltung und angeblichen "Feierlichkeiten" zum Anschlag. "Das Feuerwerk war Teil unserer jährlichen Weihnachtsfeier. Diese Veranstaltung und das Feuerwerk waren mehrere Monate im Voraus geplant worden und standen in keinerlei Zusammenhang mit dem Terroranschlag von Bondi", antwortete der Rotary Club.

Ein Sprecher der Gemeinde Padstow erklärte am 16. Dezember 2025 auf AFP-Anfrage, dass die Stadtverwaltung "keine Kenntnis von einem weiteren Ereignis mit Feuerwerk in unserer Stadt" an diesem Abend habe, und verurteilte die viralen Veröffentlichungen als "Fehlinformationen, unnötig und verletzend".

Angebliche Feier des Anschlags hat anderen Kontext

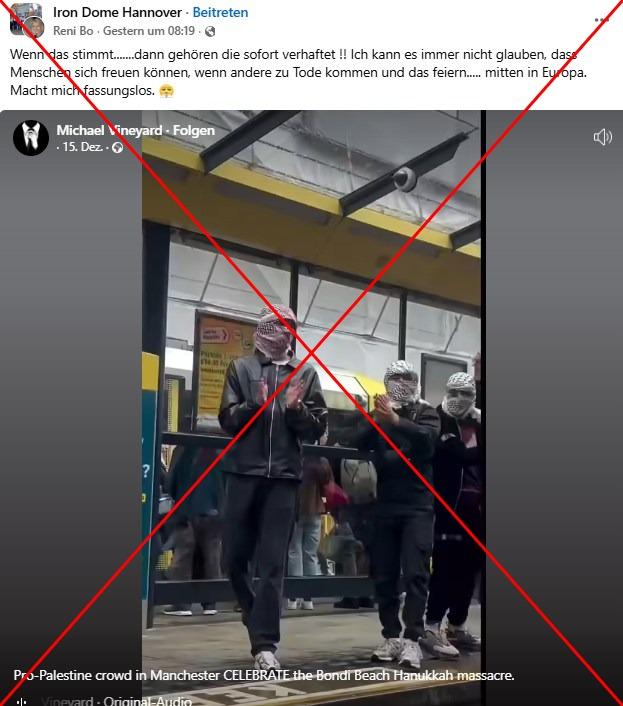

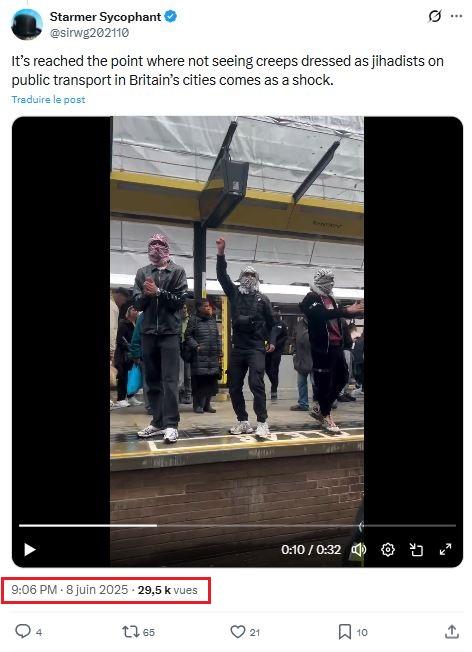

In ähnlicher Weise verbreiteten einige Nutzerinnen und Nutzer ein Video, von dem sie behaupteten, es würde eine "propalästinensische Menge in Manchester" zeigen, "die die antisemitischen Anschläge in Australien feiert". Darin sind Männer zu sehen, von denen einige Kufiyas tragen und während einer Demonstration singen und tanzen. Auf Facebook schrieb ein Nutzer am 17. Dezember 2025 dazu: "Ich kann es immer nicht glauben, dass Menschen sich freuen können, wenn andere zu Tode kommen und das feiern..... mitten in Europa. Macht mich fassungslos." Diese Behauptung wurde ebenfalls zunächst auf Englisch verbreitet und kursierte auch auf Französisch.

Das Video, das eine kleine propalästinensische Demonstration in England zeigt, stammt jedoch von Juni 2025, ohne jeglichen Bezug zu dem Anschlag vom 14. Dezember 2025 in Australien.

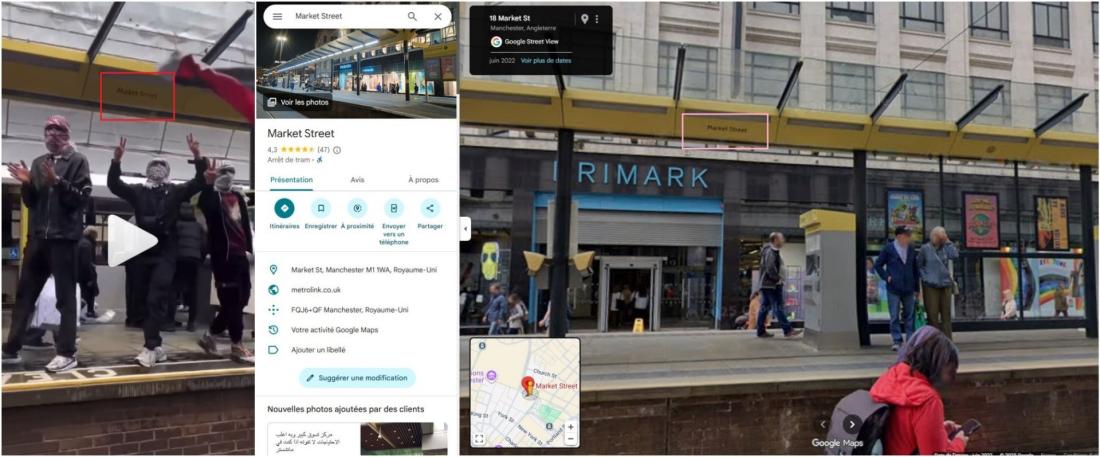

Mithilfe einer umgekehrten Bildsuche konnte AFP den Ort der Demonstration lokalisieren: Im Video ist die Straßenbahnhaltestelle Market Street in Manchester in Großbritannien zu erkennen.

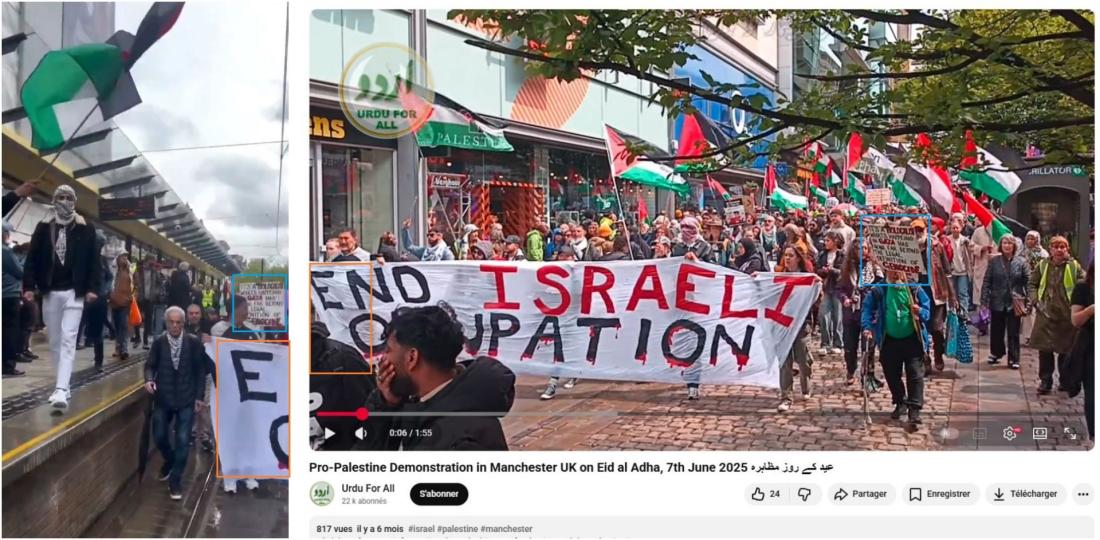

Anhand weiterer Elemente im Clip fand AFP ein weiteres Video der Demonstration: Sie fand laut dem Ersteller des Videos und dem Datum der Veröffentlichung auf Youtube am 7. Juni 2025 statt, also sieben Monate vor dem Anschlag in Sydney.

Eine Stichwortsuche nach X-Posts von dem Datum der Demonstration führte zu demselben Videoausschnitt, der in den Beiträgen mit der Falschbehauptung zu sehen ist und am Tag nach der Demonstration, also am 8. Juni 2025, hochgeladen wurde.

Es besteht somit kein Zusammenhang zwischen dem Demonstrationsvideo und dem Anschlag in Sydney.

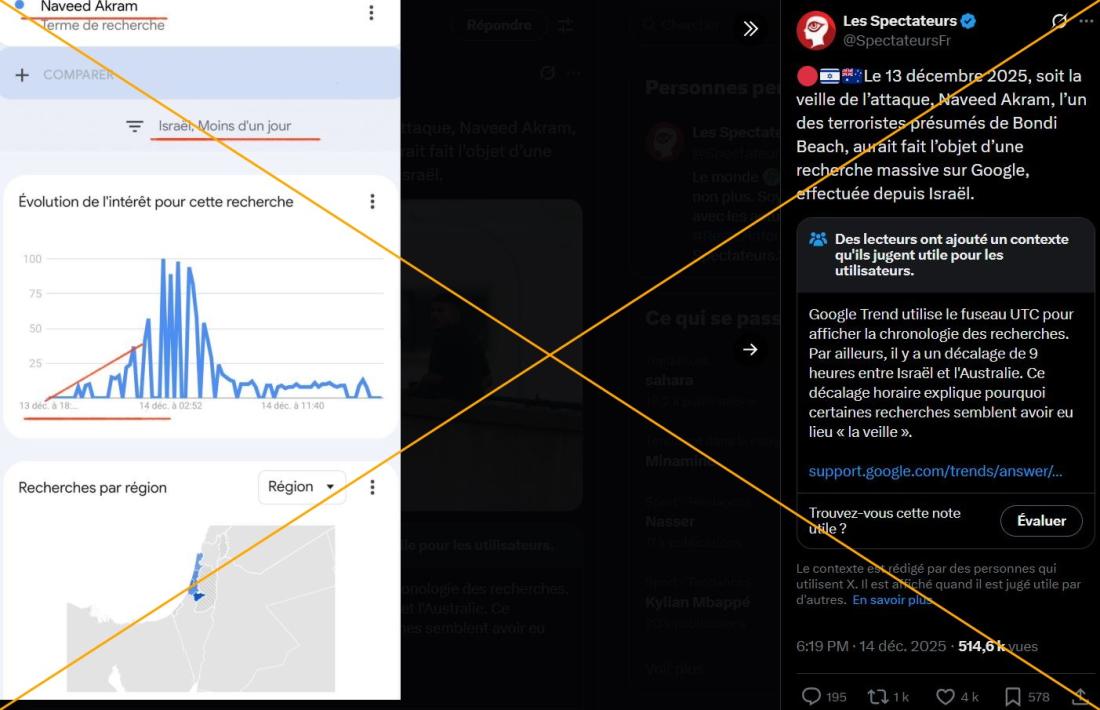

Angebliche Google-Recherchen am Tag vor dem Anschlag

"Am 13. Dezember 2025, also am Tag vor dem Anschlag, soll Naveed Akram, einer der mutmaßlichen Terroristen von Bondi Beach, Gegenstand einer massiven Google-Suche gewesen sein, die von Israel aus durchgeführt wurde", heißt es in einem französischsprachigen Beitrag auf X. Der Beitrag wurde am 14. Dezember 2025 gepostet und tausendfach geteilt.

Als angeblicher Beweis wird ein Screenshot des Statistiktools Google Trends geteilt, der einen plötzlichen Anstieg der Online-Suchanfragen nach dem Begriff "Naveed Akram" zeigt. Dem Ersteller des X-Posts zufolge würde diese Grafik auf eine außergewöhnlich hohe Suchaktivität in diesem Zeitraum hindeuten.

Ähnliche Behauptungen kursierten auf X und in mehreren Sprachen wie zum Beispiel Englisch.

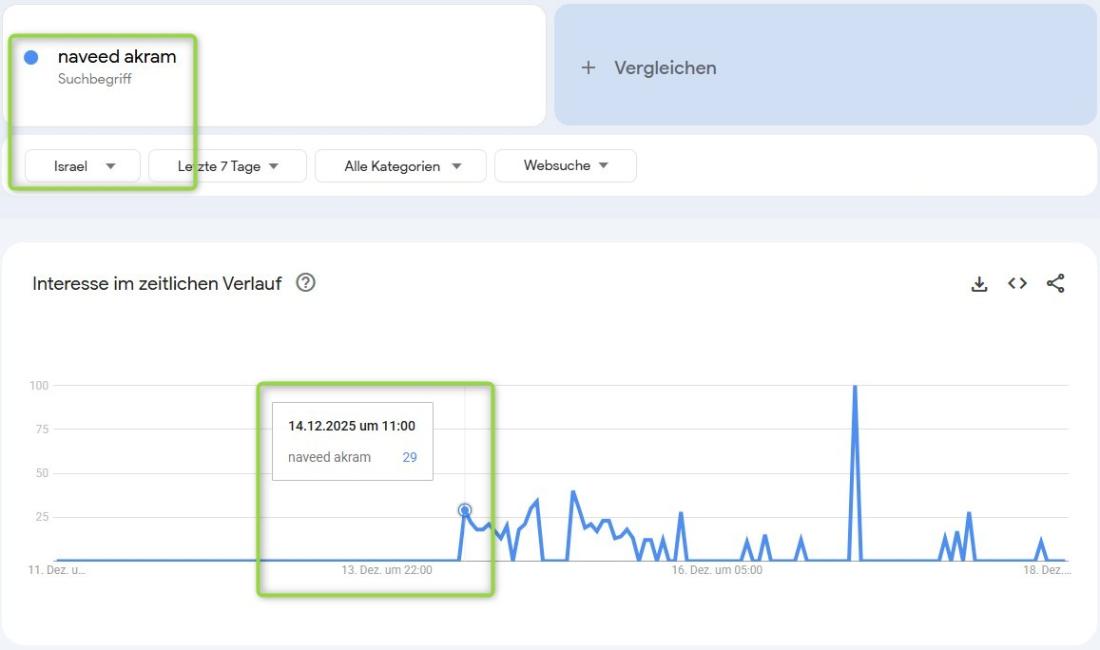

Diese Behauptung ist jedoch irreführend: Zwischen Tel Aviv und Sydney in Australien bestehen neun Stunden Zeitverschiebung, was möglicherweise dazu geführt hat, dass diese Suchergebnisse von einigen Internetnutzerinnen und -nutzern falsch interpretiert wurden.

Wie AFP nach dem Anschlag rekonstruierte, gab die Polizei an, die ersten Notrufe um 18.47 Uhr (06.47 PM) in Sydney, also um 9.47 Uhr (09.46 AM) in Tel Aviv, erhalten zu haben.

Den Daten von Google Trends zufolge erreichten die Suchanfragen im Zusammenhang mit dem Namen des mutmaßlichen Angreifers "Naveed Akram" einen ersten Höhepunkt gegen elf Uhr in Tel Aviv in Israel, also eineinhalb Stunden nach dem antisemitischen Anschlag und nicht am Tag zuvor.

Fazit: Nach dem Anschlag am Bondi Beach in Sydney in Australien am 14. Dezember 2025 kursierten online zahlreiche Falschinformationen über einen angeblichen Angreifer, die angebliche Identität des Mannes, der einen der Angreifer entwaffnete, sowie über angebliche Feiern aufgrund des Anschlags. AFP widerlegte diese Falschbehauptungen jedoch.

Copyright © AFP 2017-2026. Für die kommerzielle Nutzung dieses Inhalts ist ein Abonnement erforderlich. Klicken Sie hier für weitere Informationen.