Dieses Bild von Mädchenleichen nach einem Angriff auf eine iranische Schule ist KI-generiert

- Veröffentlicht am 16. März 2026 um 12:57

- 4 Minuten Lesezeit

- Von: Lucía DIAZ, AFP Spanien

- Übersetzung und Adaptierung: Elena CRISAN, AFP Österreich

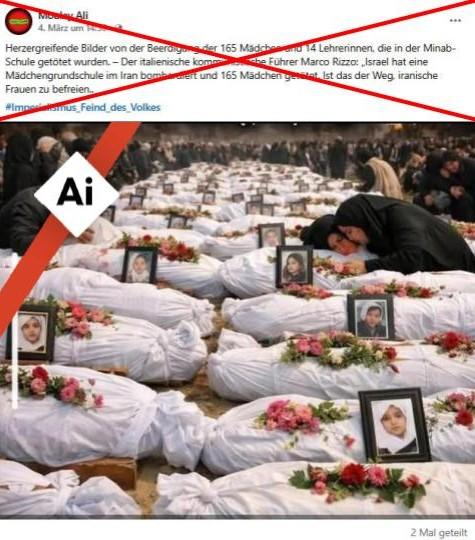

Nach dem Ausbruch des Krieges im Nahen Osten am 28. Februar 2026 berichteten iranische Medien über eine Explosion an einer Mädchenschule im Süden des Landes. Mehr als 150 Menschen sollen dabei ums Leben gekommen sein. Dazu kursierte ein Bild, das Dutzende in Tüchern eingewickelte Leichen, Fotos der Mädchen und Blumen zeigt. Allerdings handelt es sich dabei um ein KI‑generiertes Bild, wie visuelle Analysen und Erkennungstools belegen.

"Ist das der Weg, iranische Frauen zu befreien", heißt es in einem Facebook-Post vom 4. März 2026, in dem angeblich "Herzergreifende Bilder von der Beerdigung" nach einem Angriff auf eine Mädchenschule im Iran geteilt wurden.

Das Bild kursierte ebenfalls auf Plattformen wie X und Instagram sowie in anderen Sprachen wie Englisch, Französisch, Griechisch, Niederländisch, Slowakisch, Spanisch, Polnisch, Portugiesisch sowie Rumänisch.

Das weit verbreitete Bild enthält jedoch Elemente, die darauf hinweisen, dass es mit Künstlicher Intelligenz (KI) erzeugt wurde. Einige Körper im Hintergrund der Aufnahme wirken zum Beispiel unscharf.

Fachleute fanden zahlreiche Hinweise auf eine KI-Erstellung

"Das ist offensichtlich ein gefälschtes Bild", sagte Shu Hu, KI‑Forscher und Doktor der Informatik und Ingenieurwissenschaften an der Buffalo-Universität in den USA, gegenüber AFP am 6. März 2026.

Nach Angaben des Experten lasse sich dies unter anderem an der Schattenrichtung erkennen, die "nicht stimmig" sei: Auf den Blumen verlaufen die Schatten nach unten, während sie auf den Bilderrahmen nach oben zeigen, wie im folgenden Bild verdeutlicht wird. Ebenfalls auffällig seien laut Hu "verzerrte" Gesichtsmerkmale.

Siwei Lyu, Direktor des Media Forensics Laboratory der Universität Buffalo, hob zudem "doppelt vorkommende Porträts" hervor. Darauf, dass die Illustration "mit KI erzeugt wurde", würde etwa auch die "unnatürliche" Dichte der Perspektive hinweisen.

Javier Huertas, Mitglied einer Forschungsgruppe zum Thema Natural Language Processing and Deep Learning (NLP‑DL) an der Polytechnischen Universität Madrid, fielen die "verzerrten Gesichter" in den Porträts sowie "die Anzahl der Rahmen in jeder Reihe" auf. Auf einer Leiche liegen etwa drei Rahmen. Er kam in einer Stellungnahme gegenüber AFP am 5. März 2026 ebenfalls zu dem Schluss, dass das Bild mit KI erzeugt wurde.

Für Huertas ist die "geringe Qualität" des Bildes "ein absichtliches Manöver, um zu verbergen, dass es KI ist", da sie verhindert, andere Unstimmigkeiten wie etwa die Form der Hände zu erkennen, die synthetische Bilder gewöhnlich enthalten.

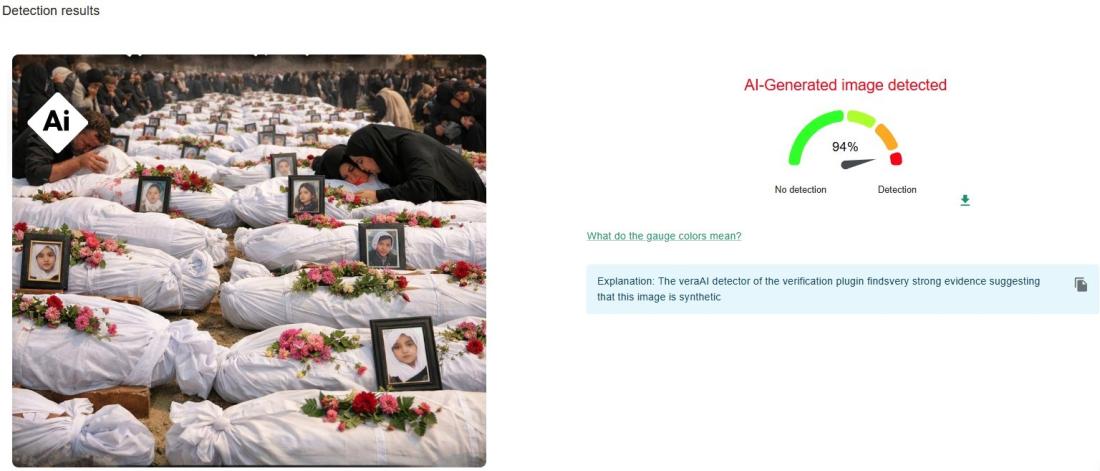

Außerdem weisen Werkzeuge wie der synthetische Bilddetektor von InVID WeVerify, an dessen Entwicklung AFP beteiligt ist, mit einer hohen Wahrscheinlichkeit von 94 Prozent darauf hin, dass die Illustration mit KI erstellt wurde.

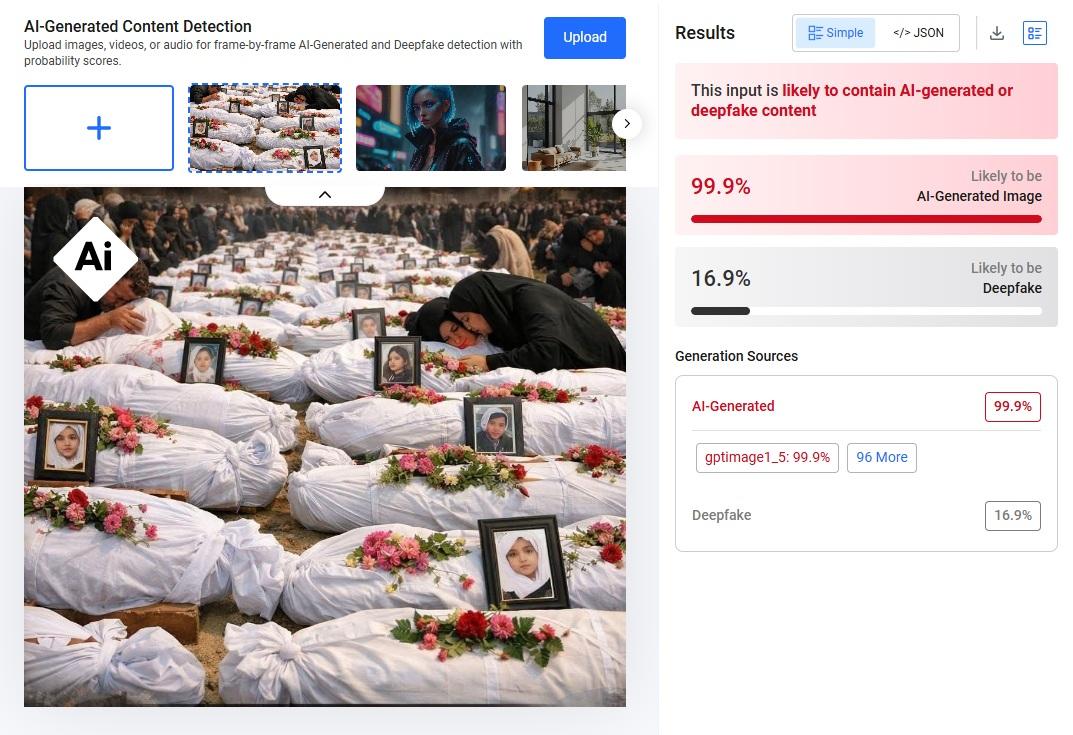

Hive Moderation, ein Tool zur Erkennung von KI-generierten Inhalten und Deepfakes, zeigte eine ähnlich hohe Wahrscheinlichkeit von 99,9 Prozent an, dass das Bild mit KI erzeugt wurde.

Der KI‑Detektor AI or Not bestätigte ebenfalls, dass das Bild "wahrscheinlich KI-generiert" ist.

Mädchenschule wurde nach Kriegsbeginn getroffen

Die USA und Israel hatten am 28. Februar 2026 eine massive Welle von Luftangriffen gegen den Iran gestartet und dabei unter anderem den obersten Führer des Landes, Ayatollah Ali Chamenei, und weitere wichtige Vertreter der iranischen Führung getötet. Als Reaktion griff die Islamische Republik Israel sowie mehrere US-Militäreinrichtungen in Staaten der Golfregion an.

Daraufhin teilten iranische Behörden mit, ein Bombenangriff habe an einer Schule in Minab im Süden des Landes mehr als 150 Menschen getötet. Weder die Vereinigten Staaten noch Israel bestätigten den Angriff. AFP konnte den Ort nicht aufsuchen, um die Angaben zu überprüfen.

Gemäß Recherchen der "New York Times" und von Reuters könnte es sich um einen US‑Angriff gehandelt haben, der auf einen Marinestützpunkt neben der Schule abzielte.

Die Sprecherin des UN-Menschenrechtsbüros in Genf, Ravina Shamdasani, forderte eine "zügige, unparteiische und gründliche Untersuchung" der Umstände des Vorfalls und erinnerte daran, dass Bombardierungen ziviler Einrichtungen als "Kriegsverbrechen" eingestuft werden können.

Der iranische Präsident Masud Peseschkian hatte die USA und Israel beschuldigt, die Grundschule mit Raketen angegriffen zu haben. Teheran spricht von einem "Kriegsverbrechen". Unterdessen sagte der US‑Außenminister Marco Rubio, die Vereinigten Staaten würden "nicht absichtlich" eine Schule angreifen und ergänzte, das Pentagon untersuche den Vorfall.

Eine solche Szene, wie im KI-Bild suggeriert, fand AFP weder in den Aufnahmen vom Tag der Beerdigung der Opfer, die von der iranischen Nachrichtenagentur ISNA veröffentlicht und von AFP verbreitet wurden, noch in Bildern internationaler Medien wie der staatlichen türkischen Nachrichtenagentur Anadolu.

Der Krieg im Nahen Osten brachte eine große Menge an Falschinformationen hervor, die AFP überprüfte.

Fazit: Ein weit verbreitetes Bild, das angeblich die Beerdigung der Opfer eines Angriffs auf eine Mädchenschule im Iran zeigt, ist mit KI erzeugt worden. Mehrere Fachleute sowie verschiedene Erkennungstools bestätigten synthetische Merkmale.

Copyright © AFP 2017-2026. Für die kommerzielle Nutzung dieses Inhalts ist ein Abonnement erforderlich. Klicken Sie hier für weitere Informationen.